МИНИСТЕРСТВО ОБРАЗОВАНИЯ И НАУКИ РОССИЙСКОЙ ФЕДЕРАЦИИ

ФЕДЕРАЛЬНОЕ ГОСУДАРСТВЕННОЕ БЮДЖЕТНОЕ

ОБРАЗОВАТЕЛЬНОЕ УЧРЕЖДЕНИЕ

ВЫСШЕГО ОБРАЗОВАНИЯ

«НИЖЕГОРОДСКИЙ ГОСУДАРСТВЕННЫЙ ТЕХНИЧЕСКИЙ

УНИВЕРСИТЕТ им. Р.Е. АЛЕКСЕЕВА»

В.А. Сьянов

ОСНОВЫ СТАТИСТИЧЕСКОЙ ТЕОРИИ

РАДИОТЕХНИЧЕСКИХ СИСТЕМ

Рекомендовано Учёным советом Нижегородского государственного

Технического университета им. Р.Е. Алексеева в качестве

учебного пособия для студентов высших учебных заведений, обучающихся

по направлениям «Радиотехника», «Радиоэлектронные системы и комплексы»

Нижний Новгород 2023

1

УДК 621.391

ББК

Рецензент

доктор физико-математических наук, профессор кафедры бионики и

статистической радиофизики Нижегородского государственного

университета им. Н.И. Лобачевского А.Г. Флаксман

Сьянов В.А.

Основы статистической теории радиотехнических систем: учеб.

пособие / В.А.Сьянов; Нижегород. гос. техн. ун-т им. Р.Е. Алексеева. –

Нижний Новгород, 2023. – с.

ISBN

Рассмотрены базовые положения теории вероятности, математической

статистики и теории случайных процессов. Уделено внимание методам описания и

преобразования стационарных случайных процессов в линейных радиотехнических

системах. Рассмотрены методы нелинейного безынерционного преобразования

стационарных случайных процессов.

Приведены методы синтеза и анализа оптимальных алгоритмов обработки

сигналов на фоне помех в системах связи и радиолокации. Рассмотрены

оптимальные алгоритмы обнаружения и различения детерминированных и

случайных сигналов на фоне аддитивного гауссовского шума. Уделено внимание

методам синтеза и анализа работы согласованных фильтров детерминированных и

случайных сигналов.

Рассмотрены статистические методы разрешения и оценки параметров

сигналов в условиях действия аддитивых гауссовских помех. Приведены функции

рассогласования простых и сложных сигналов. Рассмотрены методы оптимальной

оценки параметров сигналов на фоне гауссовского шума.

Предназначается для бакалавров, специалистов, магистров и аспирантов,

обучающихся по направлениям «Радиотехника», «Радиоэлектронные системы и

комплексы».

Рис. . Табл. .Библиогр.:

назв.

УДК 621.391

ББК

ISNB

©Нижегородский государственный

технический университет

им. Р.Е.Алексеева, 2023

© Сьянов В.А., 2023

2

ОГЛАВЛЕНИЕ

ВВЕДЕНИЕ……………………………………………………………

1. СТАТИСТИЧЕСКОЕ ОПИСАНИЕ СОБЫТИЙ И ПРОЦЕССОВ

1.1. Элементы теории

вероятности…………….................................

1.1.1. Понятия и определения………..………………………

1.1.2. Сумма и произведение событий…………

1.1.3. Теорема вероятности зависимых событий………

1.1.4. Теорема

обратной

вероятности

зависимых

событий….

1.1.5. Теорема о повторении опытов…………… …………

1.2. Законы распределения………………………………………\

1.2.1. Законы распределения СВ……………………………

1.2.2. Числовые характеристики СВ………………………

1.2.3. Биномиальное распределение………………………

1.2.4. Нормальное распределение…………………………

1.2.5. Распределение Релея………………………………

1.2.6. Равномерное распределение…………………………

1.3. Статистическое оценивание параметров…………………

1.3.1. Выборочное среднее…………………………………

1.3.2. Выборочная дисперсия………………………………

1.4. Совокупность СВ………………………………………………

1.4.1. Функция распределения совокупности СВ………

1.4.2. Условные плотности вероятности многомерного СП.

1.4.3. Числовые характеристики совокупности СВ……

1.4.4. Стационарные СП…………………………………

1.4.5. Эргодические СП………………………………………

1.4.6. Спектральные характеристики СП…………………

1.4.7. Плотность вероятности гауссовского СП……………

1.5. Воздействие СП на линейные системы………………………

1.6. Нелинейное безынерционное преобразование СП……

1.6.1. Функциональное преобразование совокупности СВ

1.6.2. Функциональное преобразование двух СВ………

1.6.3. Преобразование декартовых координат в полярные

1.7. Примеры……………………………………………………

1.7.1. Теория вероятности………………………….

1.7.2. Случайные величины. Законы распределения………

1.7.3. Случайные процессы

1.7.4 СП в линейных системах

3

6

7

7

7

8

9

9

9

9

9

12

15

15

17

19

21

22

24

27

27

29

29

32

33

34

35

38

40

40

42

43

45

45

50

55

56

2.

3.

1.7.5. СП в нелинейных системах

ОСНОВЫ СТАТИСТИЧЕСКОЙ ТЕОРИИ ОБНАРУЖЕНИЯ

СИГНАЛОВ

2.1. Задачи статистической теории обнаружения сигналов

2.2. Обнаружитель сигналов

2.3. Обнаружение детерминированного сигнала

2.4. Характеристики обнаружения

2.5

Обнаружение сигнала со случайной начальной фазой

2.6. Характеристики обнаружения

2.7. Обнаружения сигнала со случайной амплитудой и

начальной фазой

2.8. Характеристики обнаружения

2.9. Согласованный фильтр

2.10. Частотная характеристика СФ

2.11. Свойства СФ

2.12. Обнаружение пачек импульсных сигналов

2.13. Когерентный обнаружитель пачки импульсов

2.14. Некогерентный обнаружитель пачки импульсов

2.15. Накопитель пачки импульсов с логикой «k из N»

2.16. Обнаружитель сигналов на фоне небелого шума

2.17. Различение двоичных детерминированных сигналов

2.18. Характеристики оптимального различителя сигналов

2.19. Примеры

2.19.1. Обнаружение детерминированных сигналов

2.19.2. Воздействие сигнала и шума на СФ

2.19.3. Различение сигналов

РАЗРЕШЕНИЕ СИГНАЛОВ

3.1. Понятие о разрешающей способности сигналов

3.2. Функция рассогласования сигнала

3.3. Функции рассогласования импульсных сигналов

3.4. Основы теории измерения параметров сигналов

3.5. Оптимальный алгоритм измерения параметров сигналов

3.6. Измерение параметров радиолокационных синалов

3.6.1.

Неследящие измерители дальности

3.6.2.

Неследящие измерители скорости

3.7. Следящие измерители параметров цели

3.8. Точность измерения радиолокационных параметров

3.8.1

Точность измерения временного запаздывания

3.8.2.

Точность измерения частоты

4

59

66

66

69

74

78

80

83

84

86

88

91

92

94

94

96

98

99

103

107

112

112

115

119

120

120

120

122

127

128

130

131

133

133

135

136

137

3.8.3.

Точность измерения угловой координаты

3.8.4.

Точность совместного измерения параметров

3.9. Примеры

3.9.1.

Функция рассогласования сигнала

3.9.2.

Точность определения джальности и скорости

ПРИЛОЖЕНИЕ

Нормированная функция Лапласа

СПИСОК ЛИТЕРАТУРЫ

5

138

139

141

141

144

146

146

148

ВВЕДЕНИЕ

Учебное пособие предназначено для бакалавров, специалистов,

магистров и аспирантов, обучающихся по направлениям «Радиотехника»,

«Радиоэлектронные системы и комплексы». Оно может быть использовано для

изучения теоретических основ методов синтеза и анализа оптимальных

алгоритмов обработки сигналов на фоне помех в рамках дисциплин

«Статистическая теория радиотехнических систем» и «Статистическая

радиотехника».

Необходимо отметить, что по данной тематике издано большое

количество учебников, учебных пособий и монографий [1-10]. Все они имеют

значительный объем, сложный математический аппарат, что затрудняет их

широкое использование в практической работе для студентов. Авторы

постарались в доступной форме изложить тот минимальный объем

информации,

который

позволяет

усвоить

теоретические

основы

статистических методов в системах радиолокации и связи для дальнейшего их

изучения.

В первой главе рассмотрены основы теории вероятности,

математической статистики, теории случайных процессов и их линейного и

безынерционного нелинейного преобразования. Для усвоения приведенного

материала даны задачи и примеры их решения.

Во второй главе пособия приведены методы и оптимальные алгоритмы

обнаружения и разрешения сигналов на фоне помех. Рассмотрены методы

синтеза и анализа согласованных фильтров простых и сложных сигналов. В

конце главы приведены задачи и рассмотрены методы их решения.

В третьем главе излагаются статистические методы разрешения и оценки

параметров сигналов в условиях воздействия аддитивых гауссовских помех.

Приведены функции рассогласования простых и сложных сигналов.

Рассмотрены методы оптимальной оценки параметров сигналов на фоне

гауссовского шума. В конце главы приведены задачи с решениями по тематике

теоретического материала.

Авторы надеются, что данное учебное пособие поможет облегчить

освоение теоретических основ статистической теории радиотехнических

систем студентам и аспирантам радиотехнических специальностей.

6

1. СТАТИСТИЧЕСКОЕ ОПИСАНИЕ

СОБЫТИЙ И ПРОЦЕССОВ

1.1. Элементы теории вероятности

1.1.1. Основные понятия и определения

Теория

вероятностей

–

математическая

наука,

изучающая

закономерности массовых случайных событий и явлений.

Основные понятия:

Случайное событие – явление, которое может наступить или нет в N

опытах.

Пусть происходит N - кратное повторение опыта, в результате которого

случайное событие А происходит n раз.

В этом случае можно ввести относительную частоту события А

( A)

n

.

N

При повторении серий опытов будем получать разные значения ( A) .

При увеличении числа N частота события стремится к вероятности события А:

lim ( A) p( A) .

N

Основные свойства вероятности:

1. 0 P( A) 1;

2. P( A) 0;

3. невозможно е событие P( A) 0;

4. достоверно е событие P( A) 1;

5. противоположное событие P( A ) 1 P( A).

Пусть в результате N испытаний возможно возникновение нескольких

событий A, B, C ,...

Справедливы следующие аксиомы:

1.

События A, B, C ,... равновероятны, если при одних и тех же

условиях они появляются с равными вероятностями.

2.

События A, B, C ,... несовместимые если в результате испытаний

невозможно возникновение двух и более событий одновременно.

3.

События A, B, C ,... составляют полную группу событий, если в

результате испытаний возникает хотя бы одно из них.

Классическое определение вероятности события А (по Лапласу) вводится

как отношение числа благоприятных исходов возникновения события к

общему числу испытаний P( A) n N . При этом в соответствии с законом

7

больших чисел при N имеем совпадение статистической вероятности

появления события P( A) с частотой его появления .

При бесконечном числе исходов события А удобно ввести понятие меры

события. Например, при бросании точки в область G , с выделенной в ней

подобластью Q , в качестве меры вероятности удобно ввести площадь.

Вероятность такого события можно определить как отношение P( A)

SQ

SG

. При

бросании точки в отрезок длины L и определения вероятности её попадания в

меньший длины отрезок l в качестве меры вероятности такого события удобно

ввести длину P( A)

l

. Обобщая, можно ввести в качестве меры площадь,

L

длину, объем, вес и т.д. Представление вероятностей событий в виде областей

дает наглядную интерпретацию зависимых (независимых), совместимых

(несовместимых) событий, а так же их алгебраические преобразования.

1.1.2. Сумма и произведение событий

Пусть есть события А и В, получающиеся в результате N опытов.

Суммой называется событие C A B , состоящее в появление в

результате опыта хотя бы одного из этих событий.

C A B ,

Произведением

называется

событие

состоящее

в

одновременном возникновении как события А так и В.

Теорема сложения вероятностей:

Для несовместимых событий P( A B) P( A) P( B) ;

Для совместимых событий P( A B) P( A) P( B) P( A B) .

Условная вероятность для зависимых событий.

Событие А называется статистически зависимым от событий B1, B2 ,..., Bn ,

если вероятность его возникновения зависит от того осуществилось событие

Bi или нет. В противном случае вероятность события А статистически не

зависит от возникновения событий B1 , B2 ,..., Bn . Для зависимых событий

вводится условная вероятность P( A / B1 , B2 ,..., Bn )

Теорема умножения вероятностей двух зависимых событий:

P( A B) P( A) P( B / A) P( B) P( A / B) .

Теорема умножения вероятностей для n зависимых событий:

P( A1 , A2 ,..., An ) P( A1 ) P( A2 / A1 ) P( A3 / A1 A2 ) P( An / A1 A2 An 1 ) .

Следствия теоремы умножения:

1. Для статистически независимых событий А и В

P( A B) P( A) P( B / A) P( B) P( A) .

8

2. Для статистически независимых событий A1 , A2 ,..., An

P( A1 , A2 ,..., An ) P( A1 ) P( A2 ) P( An ) .

1.1.3. Теорема полной вероятности зависимых событий

Пусть событие A может наступить только при условии появления одного

из событий H1, H 2 ,..., H n , составляющих полную группу несовместимых

событий. Пусть известны вероятности появления событий P( H i ) и условные

вероятности событий P( A / H i ) . Тогда полная вероятность события А равна

n

P( A) P( H i ) P( A / H i ) .

i 1

1.1.4. Теорема обратной вероятности для зависимых событий

Пусть события H1 , H 2 ,..., H n составляют полную группу несовместимых

событий и событие А является случайным следствием возникновения события

H i . Пусть известны априорные вероятности появления событий P( H i ) и

условные вероятности событий P( A / H i ) .

Тогда условная вероятность события H i равна:

P( H i ) P( A / H i )

.

P( H i / A) n

P( H i ) P( A / H i )

i 1

1.1.5. Теорема о повторении опытов

Пусть производится N независимых испытаний при заданной

вероятности появления события А равной P( A) p . Событие А состоит в том,

что в серии из N опытов оно происходит n раз.

Тогда вероятность события А будет равна:

PN (n) CNn p n (1 p) N n ,

N!

где CNn

- биномиальный коэффициент.

n!( N n )!

1.2. Законы распределения

1.2.1. Законы распределения случайных величин

Случайному событию А можно поставить в соответствие количественную

характеристику – случайную величину.

9

Случайной, называется величина , принимающая то или иное значение в

результате опыта (испытания).

Простейшая модель случайной величины – последовательность

независимых опытов (испытаний), когда в результате каждого очередного

испытания произойдет, либо не произойдет некоторое событие.

Случайные величины (события) можно разделить на два класса –

непрерывные и дискретные.

Дискретные – бросание игральной кости.

Непрерывные – бросание точки в интервал непрерывных числовых

значений.

Будем обозначать случайную величину (СВ) , а случайные значения ей

принимаемые – x .

( x1 , x2 ,..., xn ) можно

определить,

известными

Дискретную

СВ

априорными

вероятностями

появления

соответствующих

значений

p( x1 ), p( x2 ),..., p( xn ) в виде таблицы или графика распределения дискретной

СВ.

x1

x2

x3

x4

… xn

p3

p1

p2

p4

… pn

Такое представление называется распределением вероятностей

дискретной случайной величины .

Для непрерывной случайной величины не удается ввести подобное

распределение вероятностей. Непрерывная случайная величина является

простейшей

моделью

непрерывного

случайного

процесса

(СП),

рассматриваемого в определенный момент времени.

Произвольная i -я реализация случайного процесса ( i ) (t ) имеет вид:

При этом x1 значение случайной величины 1 , являющейся выборочным

значением случайного процесса (i ) (t ) в момент времени t1 .

Универсальным как для дискретных, так и для непрерывных случайных

величин является понятие функции распределения вероятностей

(интегральной функции распределения):

10

F ( x ) P x,

где символ PA означает вероятность возникновения положительного исхода

события A , т.е. вероятность того, что случайная величина x .

Для непрерывной случайной величины F ( x ) функция распределения

будет непрерывная.

Для дискретной случайной величины функция распределения F ( x ) имеет

ступенчатый вид и может быть представлена следующим образом:

F ( x ) P xk .

xk x

Функция распределения обладает следующими свойствами:

1. F ( ) 0;

2. F ( ) 1;

3. F (x ) - неубывающая функция аргумента;

4. F ( x2 ) F ( x1 ) Px1 x2

Плотность вероятности (дифференциальная функция распределения)

непрерывной случайной величины x может быть определена через функцию

распределения. Она имеет следующий вид

W ( x )

dF ( x )

11

dx

.

Для непрерывной случайной величины x функция W (x ) непрерывна.

Функция плотности вероятности позволяет найти вероятность того, что

непрерывная случайная величина принимает значения x1 x2 :

x2

Px1 x2 W ( x )dx .

x1

Для дискретной случайной величины аналогично можно записать:

W ( x ) P xk ( x xk ) ,

k

где (x ) – дельта-функция Дирака.

Плотность вероятности смешанной случайной величины содержит как

непрерывную, так и дискретную части:

W ( x) W( н) ( x) W(д) ( x) ,

причем W ( x )dx 1 – условие нормировки.

1.2.2. Числовые характеристики случайных величин

Основными числовыми характеристиками случайных величин являются

моменты распределения – начальные и центральные. Начальные моменты k го порядка (соответственно для непрерывных и дискретных величин) имеют

вид:

n

mk x kW ( x )dx;

mk P xi xik .

i 1

Аналогично центральные моменты k -го порядка:

n

M k ( xi - m1) W ( x )dx;

M k P xi ( xi m1) k .

k

i 1

В частности, математическое ожидание (mean) и дисперсия (variance)

соответственно для непрерывной и дискретной случайной величины равны:

12

m1 xW ( x )dx;

M 2 ( xi - m1) 2W ( x )dx;

n

m1 P xi xi ;

i 1

n

M 2 P xi ( xi m1)2 .

i 1

Корень квадратный из второго центрального момента называется СКО

(standard deviation) M 2 и характеризует отклонение СВ от среднего

значения.

Корень квадратный из второго нецентрального момента называется

m2 2 m12{} D и

отклонение (root mean square – RMS)

характеризует суммарную ошибку СВ. Например, инструментальную

(регулярную) и случайную ошибки измерения.

Кроме первого и второго моментов у СВ есть другие статистические

характеристики:

xм

1. Медиана

СВ,

для

которой

выполняется

условие

P{ xм } P{ xм } 0,5 ;

2. Мода под которой понимается xmax максимальное значение плотности

распределения СВ P{ max } Pmax .

Математическое ожидание (МО) имеет смысл среднего арифметического СВ.

p p2 2 ... pn xn

.

По определению имеем m1{} 1 1

p1 p2 ... pn

МО обладает следующими свойствами:

1. m1{C} C , где С const ;

2. m1{C} Cm1{} ;

3. m1{ } m1{} m1{} , где и СВ;

4. m1{} m1{}m1{} для статистически независимых СВ.

СКО СВ характеризует её отклонение от среднего значения (МО) m1{}.

СКО имеет размерность СВ и характеризует случайную ошибку измерения

СВ.

Квадрат СКО 2 называется дисперсия. Она обладает свойствами:

1. Для линейно зависимых СВ C , где С const справедливо

2 C 22 ;

2. Для

статистически

M 2{ } 2 2 ;

независимых

13

СВ

и

справедливо

3. Можно показать, что M 2{} m2{} m12{} .

Для симметричных относительно m1 распределений имеем:

M 2i 1 0,

где i 0,1,2,...

А для первого центрального момента выполняется условие:

M 1 ( x - m1)W ( x )dx 0 .

Для произвольного распределения M 3 третий нечетный момент,

характеризует асимметрию распределения относительно m1, может быть

представлен в нормированном виде

1

M3

M 23

и называется

коэффициент асимметрии. Так, для нормального

распределения с математическим ожиданием a и дисперсией 2

( x a )2

1

,

W ( x)

exp

2

2

2

имеем M 3 0 и, следовательно, 1 0 .

Пусть случайная величина имеет распределение Релея, следующего вида

x2

x

W ( x ) exp 2 ,

2

где x 0 . Вид функции W (x ) – плотности вероятности распределения Релея

асимметричен относительного своего максимального значения. Расчет

коэффициента асимметрии дает значение 1 0,63 .

Иногда используют численную характеристику «остроты» кривой

распределения W (x ) около моды (максимального значения)

2

M4

3,

M 22

14

называемую

коэффициентом эксцесса. В частности, для нормального

распределения получаем 2 0 . В то же время для релеевского распределения

2 0,23 .

Значения 1 и 2 часто используются, чтобы характеризовать степень

отличия анализируемого распределения от нормального.

1.2.3. Биномиальное распределение

Относится к дискретным распределениям случайной величины.

Вероятность того, что в последовательности из n независимых испытаний

некоторое событие A произойдет ровно k раз, равна

Pn (k ) Cnk p k (1 p) nk .

n

Из условий нормировки имеем Cnk p k (1 p ) n k 1 .

k o

Первый и второй моменты

m1{} np; M 2 {} np(1 p ) .

распределения

соответственно

равны

(k a )2

1

exp

Можно показать, что при p const и n 1 Pn (k )

2

2

2

, распределение стремится к нормальному, где a np; 2 np(1 p ) , причем

наибольшая точность достигается при стремлении значения p к величине

p 0,5 .

При описании потока редких событий с p 1, в последовательности

независимых испытаний, имеет место другое асимптотическое выражение

a

биномиального распределения.

Пусть

p , n 1, p 1. Тогда

n

биномиальный закон распределения можно приближенно представить в

следующем виде

k

n k

a

ka

Pn (k ) Cn 1 ,

n n

a k ea

причем lim Pn (k )

.

n

k!

Закон называется

распределение Пуассона. Это распределение

представляет и самостоятельный интерес как модель потока редких событий

(поток заряженных частиц, последовательность молниевых разрядов, поток

заявок на обслуживание, поток отказов радиоаппаратуры и т.д.).

15

1.2.4. Нормальное распределение

На практике часто приходится встречаться с нормальным законом

распределения случайных величин. В соответствии с центральной предельной

теоремой А.М. Ляпунова, плотность вероятности суммы независимых,

равномерно малых слагаемых при неограниченном увеличении их числа сколь

угодно близко приближается к гаусcовскому закону распределения.

Нормальный закон распределения непрерывной случайной величины

имеет вид:

( x m1)2

1

W ( x )

exp

2 M 2

2M 2

где m1 ( ) m – математическое ожидание, а M 2 2 – дисперсия случайной

величины.

На рисунке показан нормированный гауссовский закон распределения

плотности вероятности для m 0 , 2 1. Вычислить МО и дисперсию

нормального распределения можно с помощью замены переменной и

x2

табличного интеграла Пуассона exp dx 2 или связанного с ним

2

интеграла Лапласа exp x 2 dx .

Функция распределения гауссовского закона имеет вид:

( m) 2

1 x

F ( x )

exp 22 d .

2

16

Для расчета вероятности попадания случайной величины в интервал значений

P необходимо провести вычисление интеграла

( m) 2

1

P

exp 22 d .

2

m

, имеем

Произведем замену переменой

m

2

1

m

m

P

d

exp

,

2

2 m

2

1 x

где функция ( x )

exp d

2

2

– интеграла вероятности. Она

обладает свойством ( x ) 1 ( x ) . На практике вероятность попадания

случайной величины в заданный интервал P можно вычислить через

табулированную интегральную функцию Лапласа:

2

1 x

( x )

exp 2 d .

2 0

Интеграл вероятности, связан с табулированной интегральной функцией

Лапласа простым соотношением (см. приложение П). Для неё справедливо

соотношение ( x ) ( x ) 0,5 .

1.2.5. Распределение Рэлея

Среди важных и часто встречающихся на практике распределений,

связанных с гаусcовским (нормальным), является распределение Релея.

Рассмотрим задачу нахождения распределения величины 12 22 , где

статистически

независимые

СВ

с

параметрами

1 ,2

17

m11 m12 0; M 2 1 M 2 2 2 . Выборочные значения СВ , 1 , 2

обозначим соответственно y , x1 , x2 .

Функция распределения F ( y ) величины y равна вероятности того, что

конец вектора с проекциями x1 и x2 не выйдет за пределы окружности радиуса

y x12 x22 или

F ( y )

W ( x1, x2 )dx1dx2 .

( 2)

x12 x 22 y

Двумерная плотность вероятности статистически независимых СВ имеет вид

W( 2 ) ( x1, x2 )

Перейдем к новым

соотношениями:

Тогда имеем:

x12 x22

1

.

exp

2

22

2

переменным

(, ) ,

x1 cos

x2 sin

связанным

с

исходными

.

2 ( x1, x2 )

1 2 y

F ( y )

exp 22 (, ) dd,

22 0 0

где якобиан преобразования равен

x1 x1

( x1 , x2 )

cos sin

.

x2 x2 sin cos

(, )

После вычислений функции распределения имеем

y

2

2

1 2 y

F ( y )

d exp 22 d d exp 22

22 0 0

0

y2

1 exp 2 , y 0.

2

Вычислим плотность вероятности распределения Релея, как производную от

F ( y )

18

y2

2 exp 2 , y 0 .

W ( y )

2

dy

График плотности вероятности для 1 имеет вид.

dF ( y )

y

Модальное y yM значение W ( y ) определяется из уравнения

y2

y2 y2

1

2 exp 2 4 exp 2 0 ,

dy

2

2

Откуда y M . Соответственно

1

.

W ( yM )

e

Вычисления первого и второго моментов распределения Релея дают

следующие результаты

4 2

m1 ,

M 2

.

2

2

dW ( y )

1.2.6. Равномерное распределение

В типовых задачах статистической теории радиотехнических систем

часто рассматриваются радиочастотное колебание вида:

S (t ) A(t ) cos[0t (t ) ],

где A(t ) и (t ) – детерминированные временные функции, 0 – несущая

частота колебания, а – случайная начальная фаза. Обычно допускаются с

равной вероятностью любые значения начальной фазы в пределах [0,2] . В

19

этом случае мы имеем дело с равномерно распределенной случайной

величиной .

В общем случае плотность вероятности равномерного распределения

случайной величины в интервале [a, b] имеет вид:

1

a xb

,

W ( x ) b a

.

0, x a, x b

Найдем первый и второй моменты (математическое ожидание и дисперсию)

равномерно распределенной случайной величины:

ab

(b a ) 2

m1{}

M 2 {}

;

.

2

12

Функция распределения случайной величины имеет вид:

0, x a

xa

F ( x)

, a x b.

b

a

1, x b

Для равномерно распределенной фазы радиосигнала в интервале

0 2 можно получить:

20

1

,

0 2;

2

1 2

m1{}

xdx ;

2 0

(2) 2

2

2

2

M 2 {} m2 {} m1 {}

.

3

3

W ( x)

1.3. Статистическое оценивание параметров распределения

Одной из важных задач математической статистики является разработка

методов получения обоснованных выводов о массовых явлениях и процессах

на основании анализа результатов наблюдений и экспериментов. При этом

выводы относятся не к отдельным испытаниям, не к самой анализируемой

выборке, сколь велика бы она ни была, но распространяются на весь

изучаемый процесс или явление.

Пусть, например, имеется партия из N ( N 1) каких-либо приборов

(например, транзисторов), и необходимо, выбрав случайным образом

некоторое количество n N из N и сделать вывод о качестве всей партии.

Вся совокупность изучаемых объектов или экспериментальных данных

называется генеральной совокупностью. Величина N – объем генеральной

совокупности.

Часть генеральной совокупности, наугад отобранная из нее, называется

случайной выборкой, или просто выборкой. Число n объектов (данных),

составляющих выборку, называется объемом выборки.

Обычно каждому i -му (при определенном порядке их расположения)

элементу выборки можно сопоставить определенное числовое значение xi .

Тогда выборку можно представить вектор-строкой ( x1 ,..., xn ) .

Это могут быть, например, значения реализации случайного процесса в

моменты t1 ,..., t n . Рассматриваемая выборка представляет собой реализацию

случайного вектора как совокупности случайных величин 1 ,..., n .

Используемая выборка более или менее удачно (в том или ином смысле)

характеризует изучаемые свойства генеральной совокупности. Существуют

так называемые репрезентативные выборки, которые наиболее хорошо (в

смысле того или иного критерия) представляют свойства генеральной

совокупности.

Далее, если не будет специальных оговорок, будем полагать

распределения W ( xi ) всех величин i одинаковыми, а сами величины

статистически независимыми, т.е.

21

W( n ) ( x1 ,..., xn )

n

W ( xi ) ,

i 1

где W ( xi ) не зависит от выборочного значения в момент ti , т.е. случайный

процесс является стационарным. Будем предполагать так же, что выполняется

условия эргодичности. Для таких процессов важнейшей является задача

оценки неизвестных параметров распределений генеральной совокупности.

1.3.1. Выборочное среднее

Первой задачей, которая часто возникает при статистическом анализе

имеющейся в наличии выборки, является попытка определения (оценки)

величины математического ожидания m1 ξ генеральной совокупности. Будем

далее называть величину m1 ξ – генеральным средним.

По существу, единственное, что удается сделать, это найти некоторую

статистическую оценку m̂1 генерального среднего m1 ξ .

Выберем в качестве такой оценки случайную величину вида:

1 n ,

i

n i 1

т.е. среднее арифметическое элементов выборки. Определенная таким образом

величина m̂1 называется выборочным средним. Значения x случайной

величины равны

1 n

x xi .

n i 1

Основными числовыми характеристиками случайной величины

являются математическое ожидание m1 и дисперсия M 2 .

Имеем:

1 n 1 n

m1 m1 i m1i m1{}.

n i 1 n i 1

Итак, математическое ожидание выборочного среднего совпадает с

генеральным средним, или выборочное среднее представляет собой

несмещенную оценку генерального среднего. Найдем дисперсию случайного

среднего значения

1

1 n 1 n

M 2 M 2 i 2 M 2 M 2 ,

n

n i 1 n i 1

где M 2 – дисперсия генеральной совокупности (генеральная дисперсия).

mˆ 1

22

Таким образом, с ростом объема выборки дисперсия выборочного

среднего стремится к нулю. В этом случае говорят, что выборочное среднее по

вероятности стремится к истинному генеральному среднему с увеличением

объема выборки. Такие оценки называются состоятельными. Итак, m̂1

является несмещенной и состоятельной оценкой величины .

Определим объем выборки n0 , требуемый для того, чтобы

среднеквадратическое отклонение

математического

M 2 оценки

ожидания m̂1 не превышало заданной величины . Такую оценку m̂1

будем называть точечной. Для точечной оценки имеем:

M 2 .

Тогда для дисперсии генеральной совокупности получим:

M 2

.

n0

Необходимое количество выборочных значений удовлетворяет неравенству

M

n0 22 .

Пусть, например,

M 2 .

Тогда

1

n0 2 .

2

Так, для значения 10 имеем n0 104 .

Можно использовать и иную характеристику качества оценки .

Определим вероятность того, что разность m1 по модулю не

превосходит заданного значения . Такую оценку будем называть

интервальной, поскольку она задает доверительный интервал.

Для этого необходимо знать распределение случайной величины . Будем

считать, что при n 1 распределение величины m̂1 близко к

нормальному. Тогда вместо неизвестных статистических параметров можно

поставить их оценки:

1

( x mˆ 1)2

W ( x )

exp

.

M

2

2M 2

2

Вероятность того, что оценка среднего значения случайной величины не

отличается от истинного значения на величину равна:

23

P m1 Pm1 m1

Последний

m1

( x m1)2

1

exp 2 M dx.

2M 2 m1

2

интеграл может быть вычислен через

табулированную

t

1 0

t2

нормированную функцию Лапласа (t0 )

exp( 2 )dt . Произведем

2 0

x m1

замену переменной интегрирования t

и, учитывая, что

M 2

1

M 2 M 2 получим

n

n

.

P m1 2

M

2

Так, для случая M 2 имеем:

P m1 M 2 2 n .

Так, для 102 и n 104 :

P m1 10 2 102 2 1 0,68,

откуда видно, что объем n 104 выборки не является достаточным, поскольку

обеспечивает вероятность отклонения случайной величины от истинного

значения не более 68%. Обычно требуются оценки с вероятностями 95% или

99,7%.

Отсюда можно сделать вывод, что применение разных критериев оценки

случайной величины дают разные объемы выборочных значений.

1.3.2. Выборочная дисперсия

Для определения требуемого объема выборки при оценке генерального

среднего с заданной точностью, как было показано выше, необходимо знание

генеральной дисперсии M 2 . Кроме того, оценка величины M 2 может

представлять и самостоятельный интерес.

Выберем в качестве оценки M̂ 2 генеральной дисперсии M 2

величину вида:

2

2 Mˆ 2 1 i 2 ,

n

n i 1

24

1 n

2

где i mˆ 1 – выборочное среднее. Величина называется

n i 1

выборочной дисперсией. Значения случайной величины равны:

2

2

1 n

1 n

x x xi xk .

n i 1

n k 1

Точно так же, как и в случае выборочного среднего , можно ввести в

2

рассмотрение математическое ожидание выборочной дисперсии m1

2

дисперсию выборочной дисперсии Mˆ 2 M 2 .

Представим M̂ 2 в форме:

1 n

1 n 2

2

2

ˆ

M 2 i i 2( )2 ( )2 2 ( )2 ,

n i 1

n i 1

где

1 n 2

2

i .

n i 1

Найдем математическое ожидание выборочной дисперсии. Имеем:

1 n

2

1 n n

2

2

2

m1 m1 m1 ( ) m1 m1 2 i k

n i 1

n i 1 k 1

1 n

1

n2 n 2

2

2

2

2

m2 2 m1 i (n n)m1 m2 m2

m1

n

n i 1

n2

n 1

n 1

m2 m12

M 2 .

n

n

Итак, окончательно имеем:

2

и

n n 1 M . .

m1

2

2

Таким образом, с увеличением объема выборки математическое ожидание

выборочной дисперсии стремится к генеральной дисперсии M 2 , однако при

любом конечном n , строго говоря, m1 Mˆ 2 M 2 . Следовательно,

рассматриваемая статистическая оценка дисперсии генеральной совокупности

является смещенной.

Иногда оказывается удобным пользоваться несмещенной оценкой

генеральной дисперсии. Рассмотрим величину:

n ˆ

Mˆ 2 H

M 2 ,

n 1

25

где M̂ 2 – выборочная дисперсия. Тогда

n

n

2

m1 Mˆ 2 H

m1 Mˆ 2

m1 M 2 .

n 1

n 1

n

Таким образом, оценка Mˆ 2 H

2 является несмещенной

n 1

оценкой генеральной дисперсии. Видно, что при больших значений n 1 обе

оценки совпадают.

Аналогично получим формулу и для дисперсии выборочной дисперсии.

Можно показать, что при n 1:

1

2

2

M 2 Mˆ 2 M 2 M 4 M 22 2 M 4 2 M 22

n

n

1

1

3 M 4 3M 22 M 4 M 22 .

n

n

При увеличении объема выборки

lim M 2 0 .

n

2

Таким образом, выборочная дисперсия сходится по вероятности к

генеральной дисперсии M 2 , т.е. является состоятельной оценкой величины

M 2 .

В

частности,

для

гауссовской

генеральной

совокупности

2

2

M 4 3M 2 , M 2 , так что

n 1

2

M 2 2

m1 Mˆ 2 m

n

3M 22 M 22 2 4

2

ˆ

M 2 M 2 M 2

.

n

n

Определим объем выборки nT , требуемой для того, чтобы СКО

отклонения МО от истинного значения не превышало значения . Для этого

2

необходимо, чтобы выполнялось условие M 2 M̂ 2 .

Для гауссовской генеральной совокупности, это условие имеет вид

2 M 22

. Найдем необходимый объем выборочных значений для

n

выполнения точности определения СКО в виде точечной оценки. Положим

2

вместо неравенства знак равно M 2 . Тогда получаем условие nT 2 .

2

Так, для уменьшения исходного СКО на величину 10

(в сто раз)

26

необходимо произвести вычисления для оценки значений МО и дисперсии для

nT 2 104 независимых выборочных значений.

1.4. Совокупность случайных величин

1.4.1. Функции распределения совокупности СВ

Под случайным процессом (СП) подразумевается бесконечная временная

реализация тока или напряжения случайным образом изменяющаяся во

времени (тепловой шум). Данный СП можно условно разделить на конечные

временные отрезки длительностью t 0, T в виде бесконечного числа

статистически независимых реализаций, составляющих т.н. ансамль

реализаций СП.

Для полного описания случайного процесса (СП), конечно, не достаточно

иметь распределение вероятностей его значений лишь в один момент времени.

Обычно необходимо описывать взаимную зависимость значений СП на

интервале наблюдения t 0, T в различные моменты времени t1 , t2 ,...., tn как

на приведенном ниже рисунке, где представлена произвольная i -я реализация

случайного процесса (i ) (t ) .

При этом можно говорить о совокупности случайных величин

1 (t1 ), 2 (t2 ),..., n (tn ) как более сложной и адекватной модели СП. В

этом случае необходимо перейти к рассмотрению (t ) многомерного

принимающего выборочные значения

случайного n -мерного процесса,

x( x1 ,..., xn ) в моменты времени (t1 ,...., tn ).

Вероятность того, что при этом для всех выборочных значений Pi xi

для всех 1 i n выполняется одновременно

F( n ) x,1 , x2 ,..., xn , t1 , t2 ,....,tn P1 x1 , 2 x2 ,..., n xn

называется n -мерной функцией распределения вероятностей случайного

процесса (t ) , или совокупности случайных величин 1 ,..., n .

Очевидно, что n -мерная функция распределения обладает свойством

F ( xi ) F( n ) (,...,, xi , ,...,) ,

27

где - знак бесконечно большого значения аргумента.

Если

F( n ) x1 ,..., xn F ( xi ) ,

n

i 1

n

где Fi x – обозначение операции произведения функций, то случайные

i 1

величины 1 ,..., n называются статистически независимыми.

Производная n -го порядка от функции распределения

n F( n ) x ( n )

(n)

(n)

W x

x1 ,..., xn

называется n -мерной плотностью вероятностей случайного вектора ξ (n ) ,

или совокупности случайных величин 1 ,..., n .

Соответственно n -мерная функция распределения связана с n -мерной

плотностью вероятности соотношением

F( n ) ( x1 ,..., xn )

x1

xn

(n)

... W ( x1 ,..., xn )dx1...dxn ,

откуда следует условие нормировки:

F( n ) ( ,..., )

(n)

... W ( x1 ,..., xn )dx1...dxn 1 .

Для статистически независимых величин, очевидно, имеем

n

W( n ) ( x1 ,..., xn ) W ( xi ) .

i 1

i

Многомерная функция плотности вероятности обладает свойством

согласованности:

W ( x1 ,..., xm ) ... W ( x1 ,..., xm ,..., xn )dxm 1 dxn .

Тогда для любой многомерной плотности вероятности W( n ) ( x1,...,xi ,...,xn )

можно получить одномерную плотность вероятности путём интегрирования по

соответствующим аргументам.

1.4.2. Условные плотности вероятности многомерного СП

Пусть имеется двумерный случайный процесс 1 ,2 , заданный

плотностью вероятности W ( x1 , x2 )

со статистически зависимыми

выборочными значениями в моменты времени t1 ,t2 . Для него можно ввести

условную плотность вероятности случайной величины 1 , принимающей

28

значение x1 относительно случайной величины 2 , принимающей значение x 2

в виде:

W( 2 ) ( x1, x2 )

W ( x1 / x2 )

,

W ( x2 )

где W ( x2 ) W( 2 ) ( x1 , x2 )dx1 одномерная плотность вероятности случайной

величины 2 . Условная плотность вероятности W ( x1 / x2 ) содержит больший

объем информации, чем одномерная плотность вероятности W ( x1 ) .

Условная плотность вероятности W ( x1 / x2 ) имеет следующие свойства:

1. Свойство нормировки W ( x1 / x2 )dx1 1 ;

2. Для статистически независимых случайных величин 1 и 2

справедливо W( 2) ( x1, x2 ) W ( x1 ) W ( x2 ) . Тогда для условной плотности

вероятности имеем W ( x1 / x2 ) W ( x1 ) .

3. Пусть случайные величины связаны между собой детерминированной

зависимостью 1 g ( 2 ) . Тогда двумерная плотность вероятности случайных

величин может быть выражена через одномерную плотность вероятности

вида:

W( 2 ) ( x1 , x2 ) W ( x2 )( x1 g ( x2 )) ,

где (x) – дельта-функция Дирака.

4. Формулы двумерной условной плотности вероятности случайных

величин 1 и 2 могут быть обобщены на n -мерную плотность распределения:

W( n 1) ( x1 ,..., xn 1 )

( n 1)

.

W ( x1 ,... xn 1 / xn )

W ( xn )

1.4.3. Числовые характеристики совокупности СВ

В общем случае введём смешанные начальный и центральный моменты

порядка ( k1 ,..., kn ) совместного распределения совокупности случайных

величин:

mk ...k 1 ,..., n ... x1k ...xnk W( n ) ( x1 ,..., xn )dx1 ...dxn x1k ...xnk .

1

1

n

n

1

n

Операция обозначает усреднение выборочных значений по ансамблю

реализаций случайных величин. В дальнейшем будет пользоваться для

более компактного обозначения операции статистического усреднения.

29

M k1 ...k n 1 ,..., n ... [ x1 m11]k1 ...[ xn m1n ]k n W( n ) ( x1,..., xn )dx1...dxn .

Отсюда легко получить любые начальные и центральные моменты k - го

порядка для каждой i :

mk1 i ...

M k1 i ... xi mi i

k1

xik1W( n ) ( x1 ,..., xn )dx1...dxn

W( n ) ( x1 ,..., xn )dx1...dxn

xi 1W ( xi )dxi ;

k

[ xi m1xi ] 1 W ( xi )dxi .

k

Одной из важнейших характеристик совокупности случайных величин

является смешанный центральный момент первого порядка:

M 11 i , j [ xi m1 i ][ x j m1 j ]W( 2) ( xi , x j )dxi dx j Rij .

Он представляет собой матрицу корреляции R размера (n n) выборочных

значений случайных величин i и j , состоящих из коэффициентов Rij .

Аналогичные соотношения для не центрированных случайных величин

i и j из значений m11 i , j kij образуют k матрицу ковариации.

Корреляционный и ковариационный коэффициенты матриц связаны простым

соотношением:

Rij xi x jW( 2 ) ( xi , x j )dxi dx j m1{i }m1{ j } kij m1{i }m1{ j }.

Нормированные значения коэффициентов матрицы корреляции

rij

Rij

M 2 { i }M 2 { j }

называются коэффициентами корреляции случайных величин i и j .

В частности, для статистически независимых случайных величин i и j

имеем:

Rij xi x jW ( xi )W ( x j )dxi dx j m1{ i }m1{ j }

m1{ i }m1{ j } m1{ i }m1{ j } 0.

Rij 0 ,

Случайные

величины,

для

которых

называются

некоррелированными.

Итак, статистически независимые случайные величины являются

некоррелированными. Обратное утверждение в общем случае неверно.

30

Рассмотрим физический смысл понятия корреляции случайных величин.

Для этого перейдем от величин i к центрированным и нормированным

случайным величинам i вида:

m1{ j }

m1{i }

,

;

j j

i i

M 2 {i }

M 2 { j }

принимающим значения xi и x j соответственно. Введем в рассмотрение

неотрицательную величину

L ( xi x j ) 2 W( 2 ) ( xi , x j )dxi dx j

.

( xi ) W ( xi )dxi ( x j ) W ( x j )dx j 2 ( xi x j )W ( xi , x j )dxi dx j

2

2

Нетрудно

видеть,

что

( 2)

L 2(1 rij ) 0 . Отсюда следует, что модуль

коэффициента корреляции всегда rij 1 .

Определим значение L для rij 1 . Тогда используя выражение, для

величины L с отрицательным знаком в подынтегральном выражении,

получаем L 0 . Но это значит, что для всех значений величин i и j

выполняется xi x j , т.е. i j , или

i

M 2 {i }

M 2 {i }

M 2 {i }

( j m1{ j }) m1 {i } j

m1{i }

m1{ j },

M 2 { j }

M 2 { j }

M 2 { j }

откуда получаем линейную зависимость для случайных величин i a j b .

Аналогично, для rij 1, используя запись L с положительным знаком в

подынтегральном выражении, получаем xi x j или i j , так что

i a j b . Итак, условие rij 1 означает линейную зависимость случайных

величин i и j .

Рассмотрим в качестве примера двумерное нормальное распределение

двух нормально распределенных коррелированных случайных величин с

коэффициентом корреляции r . Двумерная плотность вероятности случайных

величин имеет вид

W( 2 ) ( x1 , x2 )

1

212

( x1 a1 ) 2

1

( x1 a1 )( x2 a2 ) ( x2 a2 ) 2

r

exp

2

,

2

2

2

r

2

(

1

)

1 r2

2

1 2

1

где a1 m1{1}, a2 m2{2 }, 12 M 2{1}, 22 M 2{2 }.

Можно показать, что функция взаимной корреляции и коэффициент взаимной

корреляции в наших обозначениях равны

31

R12 r1 2 , r12 r.

Для некоррелированных нормальных величин r 0 . Из общего

выражения имеем:

( x1 a1 )2 ( x2 a2 )2

1

( 2)

W ( x1, x2 ) W ( x1 )W ( x2 )

exp

.

2

2

212

2

2

1

2

Отсюда следует важное свойство: некоррелированность нормальных

случайных величин означает также и их статистическую независимость.

1.4.4. Стационарные СП

Случайный процесс стационарен в узком смысле, если выполняется

условие

W( n ) ( x1, x2 ,..., xn , t1, t2 ,...,tn ) W( n ) ( x1, x2 ,..., xn , t1 , t2 ,...,tn ) .

Это означает, что статистические характеристики и функции СП ведут себя

неизменно во времени.

Для одномерной плотности вероятности СП получим отсутствие

временной зависимости W(1) ( x1, t1 ) W(1) ( x1 ) .

Для двумерной плотности вероятности СП при t2 t1 имеем

W( 2) ( x1, x2 , t1, t2 ) W( 2) ( x1, x2 , ) зависимость от разности t2 t1 .

Найдем первые два момента стационарного в узком смысле СП.

Математическое

ожидание

M 1{} xW ( x)dx m

и

дисперсия

M 2 {} ( x m) 2 W ( x)dx 2 не зависят от времени. Автокорреляционная

функция (АКФ) СП равна:

M 11{i , j } ( xi m)( x j m)W( 2 ) ( xi , x j , )dxi dx j kij () m 2 Rij () ,

где t j ti – зависит от разности временных отсчетов выборочных

значений.

Если условие стационарности выполняется только для первых двух

моментов СП, то такой процесс называется стационарным в широком смысле.

Из стационарности в узком смысле следует стационарность в широком

смысле, но не наоборот.

Поскольку гауссовский СП имеет отличные от нуля только первый и

второй моменты, то для него условия стационарности в широком и узком

смысле совпадают.

Перечислим основные свойства АКФ стационарного СП:

32

1. АКФ является четной функцией аргумента R() R() ;

2. Максимальное значение АКФ равно R(0) 2 ;

R() 0 ;

3. АКФ монотонно убывающая функция lim

4. Необходимое и достаточное условие существования АКФ является

выполнение соотношения

R() cos d 0 .

0

R()

, откуда

2

следует, что 1 r () 1 . Для характеристики корреляционных свойств СП

вводят время корреляции

1

k r ()d r ()d .

2

0

Время корреляции k составляет характерный временной интервал

изменения значений стационарного СП.

Коэффициент корреляции стационарного СП равен r ()

1.4.5. Эргодические СП

Ранее предполагалось, что выборочные значения многомерного

случайного

процесса

представляют

собой

случайные

величины,

статистические характеристики которых можно получить путем усреднения

выборочных значений в данный момент времени по ансамблю временных

реализаций. В реальной деятельности это практически невозможно.

Сделаем допущение о возможности получения статистических

характеристик для стационарного случайного процесса на достаточно длинном

временном интервале путем усреднения выборочных статистически

независимых значений. Такое усреднение можно назвать усреднением во

времени. Если статистические характеристики стационарного СП полученные

усреднением по ансамблю и по времени совпадают, то такой СП будет

называться стационарным и эргодическим. Необходимым и достаточным

R() 0 .

условием эргодичности является выполнение условия lim

Оценку МО, дисперсии и АКФ стационарного и эргодического СП на

временном интервале t [0, T ] можно получить в следующем виде:

T

1

ˆ

mT lim

(t )dt – оценка МО;

T T 0

T

1

2

ˆ T lim

[(t ) m]dt – оценка дисперсии;

T T 0

33

1

RˆT () lim

[(t ) m][(t ) m]dt – оценка АКФ.

T T 0

Выражения позволяют для достаточно большого временного интервала

получить оценку статистических характеристик стационарного и

эргодического СП.

T

1.4.6. Спектральные характеристики СП

Спектральные характеристики стационарного и эргодического СП могут

быть получены по теореме Винера-Хинчина, как Фурье преобразование его

АКФ:

G() R() exp( j)d – энергетический спектр СП;

1

R()

G() exp( j)d – АКФ СП.

2

Из последнего выражения можно получить дисперсию СП по формуле

Парсеваля:

1

2

G ()d .

2

Видно, что энергетический спектр СП G () характеризует распределение

мощности процесса в заданной полосе частот [, d] . Поэтому G () носит

название спектральная плотность мощности СП.

Поскольку АКФ является четной функцией своего аргумента, то для

энергетического спектра и АКФ имеем:

1

G() 2 R() cos d и R() G () cos d .

0

0

Реальный энергетический спектр имеет смысл только для области

положительных частот, тогда выражения можно представить в следующем

виде:

G( f ) 4 R() cos 2fd ,

0

R() G( f ) cos 2fdf ,

0

где f 0 – частота энергетического спектра, а

G(2f ) G() G( ) 2G() .

34

1.4.7. Плотность вероятности гауссовского СП

1. Пусть имеется n-мерный гауссовский СП (t ) , представленный своими

выборочными значениями ( x1 , x2 ,..., xn ) на интервале наблюдения t [0, T ] с

T

временным интервалом дискретизации t ti ti 1

. Многомерный

n 1

гауссовский СП имеет отличные от нуля только первый и второй моменты.

Тогда многомерная плотность вероятности такого процесса может быть

представлена в следующем виде:

W( n ) ( x1 , x2 ,..., xn )

1 n D

1

,

(

)(

)

exp

R

x

m

x

m

ij

i

i

j

j

n

(2) R

2 R i , j 1

12 R12 ... R1n

R21 22 ... R2n

где R

– определитель

...

... ... ...

Rn1 Rn 2 ... n2

корреляции n-мерного СП для которого Rij R ji ;

симметричной

матрицы

mi xi – математическое ожидание СВ;

i2 ( xi mi ) 2 – дисперсия СВ;

RijD

–

алгебраическое

дополнение

определителя

R,

полученное

произведением ( 1)i j на определитель R с вычеркнутыми i-ой строкой и j-м

столбцом.

Многомерная плотность вероятности гауссовского случайного процесса

может быть представлена в компактной векторно-матричной записи.

1

( X m) T R 1 ( X m)

exp

W ( X)

,

2

(2) n R

где X и m вектор-столбецы выборочных значений гауссовского процесса и

математического ожидания выборочных значений;

матрица R 1 - обратная матрица для матрицы корреляции R . Она может быть

получена путем транспонирования коэффициентов матрицы R так, что

справедливо R R 1 1 . Коэффициенты матрицы R 1 могут быть получены из

D

1

i j Rij

выражения: Rij (1)

.

R

35

2. Плотность вероятности n-мерного стационарного гауссовского СП

(t ) может быть представлена в векторно-матричной записи. Для плотности

вероятности с нулевым математическим ожиданием имеем:

1

XT R 1 X

W ( X)

exp

,

2

(2) n R

2 R12 ... R1n

R21 2 ... R2 n

– определитель

где R

...

... ... ...

Rn1 Rn 2 ... 2

корреляции n-мерного СП для которого Rij R ji ;

2 – дисперсия СВ.

Можно показать,

что

в

результате

симметричной

матрицы

выполнения

операции

n

XT R 1 X ( Rij1 ) xi x j – является скаляром (числом).

i , j 1

3. Рассмотрим частный случай n-мерного стационарного гауссовского

СП (t ) с некоррелированными временными отсчетами. Пусть статистические

N

характеристики такого процесса равны m 0, 2 0 , где N 0 const –

2t

спектральная плотность мощности СП в полосе 1герц. Для одномерной

плотности вероятности i-го отсчета СП имеем:

1

xi2 t

1

xi2 N 0 2

.

W ( xi )

exp 2

exp

N

2

2 t

0

Поскольку отсчеты не коррелированы, то для n-мерной плотности вероятности

можно записать:

n

n

xi2 t

n

2

N

W ( x1 ,..., xn ) W ( xi ) 0 exp i 1

.

i 1

N

t

0

Рассмотрим предельный случай при t 0, n . Многомерная плотность

вероятности СП переходит в функционал плотности вероятности:

1 T 2

W ( x(t )) C exp x (t )dt ,

N0 0

где C const , определяется из условия нормировки.

Модель данного СП представляет собой «белый» гауссовский шум.

Сколь угодно близко расположенные отсчеты такого шума не коррелированы,

36

N0

(t ) , где (t ) – дельта функция Дирака. Энергетический спектр

2

N

такого шума равен G () R() exp( j)d 0 .

2

или R()

Мощность такого шума 2 N 0 t , что означает математическую модель

нереализуемую на практике.

Приближением к такой модели в радиотехнике является «тепловой»

шум, вызванный хаотическим движением электронов в проводнике. Известно,

что спектральная плотность мощности напряжения теплового шума на

сопротивлении R , в соответствии с формулой Планка, равна:

hf

kT

G ( f ) 4kTR

,

hf

exp 1

kT

где k 1,38 10 23 дж град – постоянная Больцмана;

T – температура в градусах Кельвина T 2730 t , t температура в градусах

Цельсия;

h 6,62 1034 дж сек – постоянная Планка;

f – частота в герцах.

hf

При выполнении условия

1, что справедливо для частот вплоть до

kT

f 300ГГц, 1мм , представленное выражение переходит в формулу

Найквиста:

G ( f ) 4kTR N 0 .

Найдем мощность шума на входе радиоприемного устройства при

идеальном П-образном по частоте входном фильтре НЧ с f [0, F ] без

потерь.

37

Максимальное согласование источника теплового шума и входа приемника

достигается при выполнении условия R RВХ .

Средняя мощность теплового шума в рабочей полосе приемника, равна

2

UШ

2 4kTRF .

На входном сопротивлении приемника выделяется часть мощности

U Ш2

источника равная PВХ

Для T 2900 , F 1мгц мощность

kTF .

4 RВХ

входного теплового равна PВХ 4 1015 вт .

1.5. Воздействие СП на линейные системы

Линейной,

называется

система,

осуществляющая

линейные

преобразования входных сигналов. В такой системе справедлив принцип

суперпозиций, заключающийся в том, что сумма входных воздействий может

быть найдена путем суммирования откликов по каждому из воздействий в

отдельности. Для анализа процессов в таких системах используются методы:

решения дифференциальных уравнений, импульсных и переходных

характеристик (интеграл Дюамеля), метод преобразования Фурье и Лапласа и

другие.

Пусть имеется линейная система с передаточной функцией K ( j) на

входе которой поступает стационарный случайный процесс (t ) с известными

статистическими характеристиками m 0 и АКФ R () .

Необходимо найти статистические характеристики случайного процесса

(t ) на выходе линейной системы.

Известно, что передаточная и импульсная характеристики в линейной

системе связаны прямым и обратным преобразованиями Фурье:

38

1

g (t )

K ( j) exp( jt )d – импульсная характеристика линейной

2

системы (фильтра);

K ( j) g (t ) exp( jt )dt – передаточная функция системы.

Будем предполагать, что g (t ) 0, при t 0 линейная система устойчива, так,

что при воздействии дельта импульса на её входе lim g (t ) 0 .

t

Входной процесс (t ) можно представить через его спектральную

характеристику:

S ( j) (t ) exp( jt )dt ,

(1. 1)

1

(t )

(1.2)

S ( j) exp( jt )d .

2

Для процесса на выходе фильтра имеем:

1

(t )

(1.3)

S ( j) K ( j) exp( jt )d .

2

Перейдем от отдельной реализации к ансамблю реализаций, проведя

статистическое усреднение полученных выражений по ансамблю

выражения (1.3). Меняя местами операции интегрирования и статистического

усреднения, имеем:

1

(t )

S ( j) K ( j) exp( jt )d 0 , поскольку

2

S ( j) (t ) exp( jt )dt 0 .

Таким образом, спектральная характеристика СП при сделанных

допущениях в установившемся режиме (без учета начальных условий и

переходных процессов в системе) является случайной величиной,

математическое ожидание которой равно нулю.

Найдем АКФ процесса на выходе фильтра. Из (1.3) имеем:

1

(t )

(1.4)

S ( j) K ( j) exp( j(t ))d

2

Поскольку (t ) функция вещественная, то выражение (1.4) не изменится, если

в правой его части перейти к комплексно-сопряженным спектральным

характеристикам:

39

1

(t )

S ( j) K ( j) exp( j(t ))d .

2

Используя выражения (1.4) и (1.5), имеем:

R ( ) (t )(t )

(1.5)

.

1

S

(

j

)

S

(

j

)

K

(

j

)

K

(

j

)

exp(

j

)

exp[

j

(

)

t

]

d

d

4

Учтем, что входной случайный процесс (t ) стационарен, а случайные

спектральные характеристики статистически независимы и имеют

- коррелиров анную АКФ:

(1.6)

S ( j)S ( j) 2G()( ) ,

где G () - энергетический спектр случайного процесса (t ) . Подставим

выражение (1.6) в интегральное выражение и учитывая фильтрующее свойство

-функции, получим:

1

2

R ( )

G ( ) K ( j) exp( j)d .

(1.7)

2

Из выражения (1.7) видно, что энергетические спектры входного и

выходного случайного процесса в установившемся режиме связаны

соотношением:

2

G ( ) K ( j) G ( ) .

(1.8)

Соотношение (1.8) позволяет найти связь спектральных характеристик

входного и выходного процессов в частотной области. Определим связь АКФ

входного и выходного случайных процессов.

2

Определим Фурье-преобразование от K ( j) . Имеем:

K ( j) g (t ) exp( jt )dt

.

K ( j) g (t ) exp( jt )dt

Найдем квадрат модуля передаточной функции фильтра:

K ( j) K ( j) g (t ) g (t ) exp[ j(t t )]dtdt .

Сделаем замену переменной t t , имеем:

2

K ( j) K ( j) K ( j) g (t ) g (t )dt exp( j)d .

40

(1.9)

Функцию в выражении (1.9) в фигурных скобках можно назвать АКФ

импульсной характеристики фильтра:

Rg () g (t ) g (t )dt .

(1.10)

Возьмем от выражения (1.9) от левой и правой части преобразование

Фурье и с учетом соотношения (1.10) получим:

R (t ) R (t ) Rg (t ) R ( ) Rg (t )d Rg ( ) R (t )d ,

(1.11)

где - обозначение операции временной свёртки.

Выражения (1.8) определяет связь СП на входе и выходе линейной

системы в частотной области в установившемся режиме. Выражение (1.11)

связывает входной и выходной СП без учета переходных процессов.

1.6. Нелинейное безынерционное преобразование СП

1.6.1. Функциональное преобразование совокупности СВ

Пусть задана совместная плотность вероятности W( n ) ( x1,..., xn )

непрерывных случайных величин 1 ,..., n . Пусть также задана совокупность

однозначных непрерывных функций yi f i ( x1 ,..., xn ) n переменных,

определяющая связь значений

x1 ,..., xn случайных величин

1 ,..., n

со

значениями y1 ,..., yn новых случайных величин 1 ,..., n , так что

1 f1 ( 1 ,..., n )

(1.12)

.......... .......... ...... .

f ( ,..., )

n

n 1

n

Такое преобразование будем называть нелинейным безынерционным

преобразованием. Необходимо определить совместную плотность вероятности

W( n ) ( y1,..., yn ) .

Начнем с рассмотрения одномерного случая. Пусть имеется случайная

величина с распределением W (x ) . Задана функция y f (x ) , определяющая

связь значений у новой случайной величины со значениями x величины .

При этом определяется как f () . Предположим, прежде всего, что связь

и однозначная, то есть существует однозначная и непрерывная функция

() . Вероятности нахождения случайных величин связана соотношением:

P{ y0 y0 dy} P{x0 x0 dx} ,

где y0 f ( x0 ) .

41

Последнее соотношение эквивалентно:

W ( y )dy W ( x )dx .

Учтем взаимную связь y f (x ) и обратное соотношение x ( y ) .

Тогда для связи плотностей вероятностей имеем:

dx

d( y )

.

(1.13)

W ( y )dy W ( x )

W [( y )]

dy

dy

Абсолютное значение производной связано с тем, что функции W ( y ) и

W (x ) не отрицательны.

Пусть теперь функция x ( y ) неоднозначна и имеет l ветвей. В этом

случае выходной случайной величине y y dy соответствует одно из входных

значений xi xi dx , для i 1,2,..., l .

На рисунке представлен частный случай квадратичной зависимости l 2

.

В этом случае выражение (1.13) можно представить в обобщенном виде:

l

d ( y )

,

(1.14)

W ( y ) W [i ( y )] i

dy

i 1

где значения i ( y ) и

di ( y )

соответствуют i-той ветви неоднозначной

dy

функции.

Полученный результат можно обобщить на случай n-мерной плотности

вероятности. Будем предполагать, что для системы преобразования (1.12) есть

набор взаимно однозначных преобразований вида:

1 1 ( 1 ,..., n )

(1.15)

.......... .......... ...... .

( ,..., )

n

n

1

n

По аналогии с ранее полученным выражением имеем:

W( n ) ( y1,..., yn ) W( n ) (1 ( y1,... yn ),...,n ( y1,... yn )) Dn ,

где Dn - якобиан преобразования случайных величин ( 1 ,..., n ) в ( 1 ,..., n ) :

42

1

y1

( 1 ,..., n )

Dn

...

( 1 ,..., n ) n

y1

1

yn

... ... .

n

...

yn

...

В случае, если обратные функции (1.15) неоднозначные и имеют l ветвей

неоднозначности, необходимо осуществлять суммирование по каждой из

ветвей вида (1.14).

1.6.2. Функциональные преобразования двух СВ

Пусть известна плотность вероятности W( 2) ( x1, x2 ) . Необходимо найти

W( 2) ( y1, y2 ) , при известной функциональной зависимости:

1 1

.

f

(

,

)

2

1 2

Пусть обратная функция 2 ( 1 , 2 ) известна и однозначна. Тогда

якобиан преобразования от ( x1 , x2 ) к ( y1 , y2 ) имеет вид:

1

0

( x1 , x2 ) ( y , y ) ( y , y )

1 2

1 2 .

( y1 , y2 )

y1

y2

Для двумерной плотности вероятности после преобразований имеем:

( y1 , y2 )

W( 2 ) ( y1 , y2 ) W( 2 ) ( y1 , ( y1 , y2 ))

.

y2

Тогда для одномерной плотности вероятности нелинейного преобразования

имеем:

( y1 , y2 )

( 2)

dy1 . (1.16)

W ( y2 ) W ( y1 , y2 )dy1 W( 2 ) ( y1 , ( y1 , y2 ))

y2

Выражение (1.16) позволяет найти на выходе устройства плотности

вероятности при нелинейных преобразованиях на входах для: суммы,

разности, произведения и частного двух входных случайных процессов 1 и 2

при известном совместном распределении W( 2) ( y1, y2 ) .

Рассмотрим несколько важнейших частных случаев. Из (1.16) получим:

1. Для суммы 2 1 2 , имеем W2 ( y2 ) W( 2 ) ( y1 , y2 y1 )dy1 ;

43

2. Для разности 2 1 2 , имеем W2 ( y2 ) W( 2 ) ( y1 , y2 y1 )dy1 ;

3. Для произведения 2 1 2 , имеем W2 ( y2 ) W( 2) ( y1 , y2 / y1 )

dy1

;

y1

4. Для частного 2 1 / 2 , имеем W ( y2 ) W( 2 ) ( y1 , y2 y1 ) y1 dy1 .

2

Для статистически независимых входных процессов имеем:

W( 2) ( y1, y2 ) W1 ( x1 ) W2 ( x2 ) .

Подставляя в полученные выражения соответствующие распределения,

можно получить статистические характеристики выходных процессов.

1.6.3. Преобразование декартовых координат в полярные

Пусть ( 1 , 2 ) – случайные декартовые координаты некоторой точки

( x1 , x2 ) (конца вектора) на плоскости. Задано распределение W( 2) ( x1, x2 ) .

Пусть входные процессы ( 1 , 2 ) статистически независимы, имеют

гауссовское распределение с параметрами m1 a; m2 b; 1 2 .

Необходимо найти совместную плотность вероятности W( 2) ( y1, y2 ) значений

случайных величин ( 1 , 2 ) вида

1 12 22 ,

1 0;

.

2 arctg 2 1, 0 2 2

Обозначим значения случайных величин ( 1 , 2 ) соответственно (, ) ,

вместо ( y1 , y2 ), как это обычно принято при переходе к полярным

координатам. Декартовы координаты связаны с полярными следующими

нелинейными соотношениями

x1 cos

.

x2 sin

Якобиан преобразования имеет вид:

( x1, x2 ) cos sin

.

sin cos

(, )

Тогда

и

для

статистически

W( 2) (, ) W( 2) ( cos, sin )

независимых входных процессов имеем W( 2) (, ) W1 ( cos ) W2 ( sin ) .

Заметим, что случайные величины ( 1 , 2 ) в последнем случае не

являются статистически независимыми.

44

Для одномерных распределений модуля и фазы вектора ( x1 , x2 ) в

общем случае имеем:

2

W1 () W( 2 ) ( cos , sin )d – для начальной фазы;

0

W2 () W( 2 ) ( cos , sin )d – для огибающей процесса.

0

Для двумерной плотности вероятности имеем:

( x1 a )2 ( x2 b)2

1

( 2)

W ( x1, x2 )

exp

.

2

22

2

Перейдем к полярной системе координат и получим:

( cos a )2 ( sin b)2

( 2)

W (, )

exp

.

2

2

22

Одномерное распределение огибающей выходного процесса равно:

2

1

2

2

W ()

exp

2 ( cos a ) ( sin b) d

2

2 0

2

.

2 a 2 b2 2

exp

exp 2 ( a cos b sin )d

2

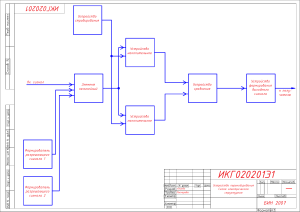

22

2

0

Обозначим Z a 2 b2 ; arctg b a , тогда имеем:

2 Z 2 Z

I

W () 2 exp

,

(1.17)

2 0 2

2

2

1

где I 0 ( x )

expx cos( )d – модифицированная функция Бесселя

2 0

нулевого порядка. Распределение (1.17) называется распределением РелеяРайса, или обобщенным релеевским.

45

В частном случае a b 0 имеем Z 0 и распределение переходит в

распределение Релея.

2

W () 2 exp 2 .

2

Можно показать, распределение Релея-Райса характеризует одномерное

распределение огибающей суммы детерминированного сигнала и нормального

шума на выходе линейного детектора.

1.7. Примеры

1.7.1. Теория вероятности

Пример 1

Однотипная продукция с браком разложена в три одинаковых ящика. В

первом ящике брака 4 из 100 штук, во втором 6 из 120 штук, в третьем 8 из 80

штук. Из одного из ящиков равновероятно берется одна деталь. Чему равна

вероятность P( A) того, что она окажется бракованной?

Пусть P ( H 1 ) - вероятность того, что деталь взята из 1-го ящика, P( H 2 ) из второго, P ( H 3 ) из третьего. По условию задачи эти события

равновероятны:

P( H1 ) P( H 2 ) P( H 3 ) 1 .

3

46

Условные вероятности события P A равны:

Hi

, P A 6

, P A 1 .

P A 4

10

100

120 H 3

H1

H2

Тогда полная вероятность искомого события равна:

3

1

0,063(3) .

P( A) P( H i ) P A 1 1 1 19

20 10

300

H i 3 25

i 1

Пример 2

На производстве работают три автоматических линии, выпускающие

качественные изделия с вероятностями: p1 0,9; p2 0,95; p3 0,8 . Первая

линия дает 50% продукции, вторая 30%, третья 20%. Определить вероятность

того, что наугад выбранное качественное изделие сделано на первой, второй

или третьей линии?

Пусть событие A состоит в том, что выбранное изделие качественное.

Пусть P ( Bi ) – вероятность того, что изделие сделано на i -ой линии. По

P( B1 ) 0,5; P( B2 ) 0,3; P( B3 ) 0,2 .

условию

задачи

обозначим:

Соответственно условная вероятность того, что выбрано качественное изделие

iс

ой

линии

равны

соответственно:

Тогда

апостериорную

P A 0,98; P A 0,95; P A 0,8 .

B1

B2

B3

вероятность того, что качественное изделие сделано на i - ой линии по

P A

Bi

B

формуле Байеса равно: P i P( Bi )

. Для вероятности события A

A

P( A)

P( A) P( Bi )P A 0,5 0,98 0,3 0,95 0,2 0,8 0,935.

Bi

i 1

Подставим найденные значения в формулу Байеса:

1.

Для

качественного

изделия

с

первой

линии

0,98

P B1 0,5

0,524 ;

A

0,935

2.

Для

качественного

изделия

со

второй

линии

0,95

P B2 0,3

0,305 ;

A

0,935

3.

Для

качественного

изделия

с

третьей

линии

0,8

B

0,171 .

P 3 0,2

A

0,935

имеем:

3

47

Пример 3

Бинарный источник дискретных сообщений передаёт 1 и 0 с априорными

вероятностями P1 и P0=1─P1. В канале вследствие действия помех возникают

ошибки. Условная вероятность ошибочного приёма нуля при передачи

единицы равна P(0´/1), а условная вероятность ошибочного приема единицы

при передачи нуля равна P(1´/0). Найти условную вероятность передачи

единицы P(1/1´) и нуля P(0/1´), если на приёмном конце получена единица 1´.

Найти условную вероятность передачи единицы P(1/0´) и нуля P(0/0´), если на

приёмном конце получен ноль 0´.

Исходные данные: P1=0,6; P(0´/1)=0,2; P(1´/0)=0,1.

На рисунке показан процесс передачи бинарного сигнала в цифровом

канале с помехами.

P (1)

P(1)

P(1)

P(1)

P(0 1)

P(1)

P(1 0)

P(1)

P(0)

P(1)

P(1)

P(0)

Найдём полную вероятность того, что на приёмном конце получена

единица P (1) или ноль P(0) :

P(1) P(1) P(1 / 1) P(0) P(1 / 0) ,

P(0) P(1) P(0 / 1) P(0) P(0 / 0) .

По формуле Байеса для условной вероятности при приеме «единицы» и

«нуля» имеем:

P(1) P(1 / 1)

,

P(1 / 1)

P(1)

P(0) P(0 / 0)

.

P(0 / 0)

P(0)

Сумма условных вероятностей событий P(1 / 0) и P(0 / 0) составляет

полную группу событий, поэтому для них выполняется условие

P(1 / 0) P(0 / 0) 1. Аналогично для условных вероятностей справедливо

P(0 / 1) P(1 / 1) 1 .

Подставляя данные условия задачи в полученные выражения имеем:

P(1) 0,52; P(0) 0,48; P(1 / 1) 0,923; P(0 / 0) 0,75.

48

Условные вероятности при приеме нуля и единицы составляют полную

группу событий, откуда получим:

P (1 / 1) P (0 1) 1 ,

P(0 / 0) P(1 0) 1 .

Подставляя численные значения окончательно имеем P(0 / 1) 0,077 ,

P(1 / 0) 0,25 .

Пример 4

По каналу связи, подверженному воздействию помех, передается одна из

двух команд управления в виде кодовых комбинаций «11111» или «00000» с

априорными вероятностями появления 0,7 и 0,3 соответственно. Наличие

помех приводит к уменьшению вероятности правильного приема «0» и «1» до

величины p 0,6 при независимых ошибках передаваемых символов в

кодовой комбинации. На выходе приемного устройства зарегистрирована

комбинация «10110». Найти вероятности передачи входных команд для

принятия «оптимального» решения устройства управления.

Обозначим за А – событие, состоящее в приеме комбинации «10110».

Под гипотезой H1 будем предполагать, что была передана комбинация

«11111» с вероятностью P ( H1 ) 0,7 , а гипотезой H 2 – комбинация «00000» с

вероятностью P( H 2 ) 0,3 . Найдем условную вероятность приема кодовой

комбинации «10110» вместо «11111». Она равна:

P( A H1 ) p(1 p ) pp(1 p ) 0,6 0,4 0,6 0,6 0,4 0,035

Аналогично условная вероятность приема кодовой комбинации «10110»

вместо «00000» равна:

P( A H 2 ) (1 p ) p(1 p )(1 p ) p 0,4 0,6 0,4 0,4 0,6 0,023

Найдем полную вероятность события А:

P( A) P( H1 ) P( A / H1 ) P( H 2 ) P( A / H 2 ) 0,0314

По формуле Байеса имеем:

P( H1 ) P( A / H1 )

0,78 .

P( H1 / A)

P( A)

Аналогично для условной вероятности передачи нулевой комбинации

имеем:

P( H 2 ) P( A / H 2 )

P( H 2 / A)

0,22 .

P( A)

Сравнивая условные вероятности передачи кодовых комбинаций

«оптимальный» приемник принимает решение: был передан управляющий

сигнал «11111».

49

Пример 5

В бинарном канале связи передается последовательность из нулей и

единиц. Вероятность ошибки при передачи бита равна P01 P10 102 .

Определить вероятность того, что при приеме байта информации произойдет

ошибка в двух битах.

Вероятность двукратной ошибки P( 2) P012 (1 P01 )6 в конкретной

кодовой комбинации.

Вероятность двукратной ошибки с учетом случайного расположения

ошибочных

символов

в

передаваемом

сообщении

равна

8! 4

( 2)

Pош

C82 P( 2)

10 (0,99)6 28 0,0001 0,941 0,00263.

6!2!

Пример 6

Производится 6 независимых выстрелов по цели. Вероятность попадания

в цель при одном выстреле p 0,75 . Вычислить:

1. Вероятность пяти попаданий;

2. Вероятность не менее пяти попаданий;

3. Вероятность более трех промахов.

1. Вероятность промаха равна q 1 p 0,25. Вероятность пяти попаданий

из шести выстрелов равна P65 C65 p5 q 0,356 .

2. Вероятность того, что будет не менее пяти попаданий при стрельбе

складывается из вероятности 5 из 6 попаданий и 6 из 6 попаданий и

равна: P6n (n 5) C65 p5q C66 p6 0,534 .