Регрессия при интервальной ошибке

реклама

МАК-2013, Барнаул, 28 июня 2013

Построение и анализ

регрессионных зависимостей

при интервальной ошибке

Жилин Сергей Иванович

Алтайский госуниверситет

2

План

Регрессия при интервальной ошибке

Эксперименты по ММП- и МЦН-прогнозированию

Схема эксперимента

Распределения ошибки

Результаты сравнения

Выявление выбросов

Регрессия: классический взгляд

Ошибки: нормальные или ограниченные

Регрессия при интервальной ошибке: основы

Регрессия при интервальной ошибке: открытые вопросы

Идея метода

Простой пример

Примеры приложений

Планирование эксперимента

Контекст

Критерии оптимальности плана эксперимента

Сравнение D- и IE-оптимального планирования

Результаты сравнения

Регрессия

при интервальной ошибке

Регрессия: классический взгляд

Ошибки: нормальные или ограниченные

Регрессия при интервальной ошибке: основы

Регрессия при интервальной ошибке:

открытые вопросы

Регрессия при интервальной ошибке

4

Регрессия: классический взгляд

Регрессия – зависимость среднего значения

случайной величины от некоторой другой величины

или нескольких величин, или условное мат. ожидание:

M[y|x] = f(x).

Мат. энциклопедия, 1984

Модель линейной регрессии

p

y f (x) e 0 j x j e xTα e,

j 1

x (1, x1, x2 ,..., x p )T

– вектор входных переменных

α ( 0 ,1, 2 ,..., p )T – вектор параметров регрессии

Регрессия при интервальной ошибке

5

Регрессия: классический взгляд

Регрессия как «черный ящик»

Предикторы

x = (x1,…,xp)T

измеряются

точно

x1

x2

…

f(x, )

xp

Функция-модель

известной структуры

+

e

Параметры модели

должны быть

оценены

y

Отклик

y

измеряется с

ошибкой

Ошибка наблюдения

Регрессия при интервальной ошибке

6

Линейная регрессия

Метод наименьших квадратов

Поиск

модели, наиболее согласующейся с

данными:

α arg minp J (α ) X X

αR

T

1

T

X y,

1 N

1

T 2

J (α ) ( yi xi α ) (y Xα )T (y Xα ),

2 i 1

2

x1T

X ,

xT

N

y1

y .

y N

Регрессия при интервальной ошибке

7

Линейная регрессия

Теорема Гаусса-Маркова

Если для линейной регрессии y XT α e

выполнены условия

Mei = 0;

(1)

Mei2 = s2 ;

(2)

Meiej = 0 для i j ;

(3)

rk X = p+1 < n ;

(4)

xj детерминированы;

(5)

ei имеют нормальное распределение N(0, s2),

(6)

то МНК-оценки являются несмещенными линейными

оценками с минимальной дисперсией, имеющими нормальное

распределение. Кроме того, МНК-оценки совпадают с

оценками максимального правдоподобия.

Регрессия при интервальной ошибке

Линейная регрессия

Теорема Гаусса-Маркова

Если

условия (2)-(3) на вторые моменты ошибок не

выполнены (гетероскедастичность), то

МНК-оценки перестают быть эффективными в своем

классе

оценки значимости коэффициентов становятся излишне

оптимистичными

Теорема Айткена

Если

в классической модели линейной регрессии

нарушены предположения (2)-(3), то наиболее

эффективной в классе линейных несмещенных

оценок оказывается оценка обобщенного МНК

(ОМНК).

8

Регрессия при интервальной ошибке

9

Линейная регрессия

Обобщенный МНК

Пусть С – ковариационная матрица ошибок

регрессии

Тогда ОМНК-оценки вычисляются так:

1

αОМНК X С X

Проблема:

T

1

T

1

X С y

по N наблюдениям невозможно оценить

матрицу С, содержащую N(N – 1)/2 неизвестных, без

дополнительных гипотез (о виде зависимости

ошибок)

Регрессия при интервальной ошибке

10

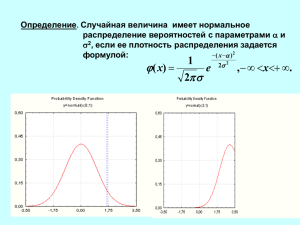

Ошибки: нормальны или ограничены?

s s s s s s s s s s s

Регрессия при интервальной ошибке

11

Регрессия: ошибка ограничена

Регрессия как «черный ящик»

Предикторы

x = (x1,…,xp)

измеряются

точно

x1

x2

…

f(x, )

xp

Функция-модель

известной структуры

+

e

Параметры модели

должны быть

оценены

y

Отклик

y

измеряется с

ошибкой

Ошибка наблюдения

наблюдения

Ошибка

ограничена

Регрессия при интервальной ошибке

Ошибка регрессии

Классический статистический подход часто

подразумевает, что ошибка измерений имеет

нормальное распределение

На практике оказывается, что ошибка измерений

скорее интервальна, чем нормальна

«Интервальная» означает «неизвестная, но

ограниченная»:

e [j, j], где j – граница ошибки в j-м измерении, j=1,…,n

Никаких других предположений об ошибке нет

12

Регрессия при интервальной ошибке

13

Регрессия при интервальной ошибке

Структура модели y = f (x,) предполагается

известной с точностью до параметров,

x измеряется точно, y – с предельной ошибкой .

Каждая строка (xj , yj , j) таблицы измерений

ограничивает возможные значения параметров

множеством

Sj

y j j f ( x j , ) y j j , j 1,...,n.

Значения параметров , удовлетворяющие всем

ограничениям, образуют множество

неопределенности

n

A S j

j 1

Регрессия при интервальной ошибке

14

Регрессия при интервальной ошибке

Построение модели y = 1 + 2x

Пространство (1, 2)

Пространство (x, y)

y

Множество

допустимых

моделей

Множество

допустимых

моделей x

2

Множество

неопределенности A

(ОДЗ) Множество

неограничено =

неопределенности

A

недостаточно

данных

(ОДЗ)

Множество

неопределенности A

(ОДЗ)

1

Регрессия при интервальной ошибке

15

Регрессия при интервальной ошибке

Задачи, решаемые в отношении

множества неопределенности A (ОДЗ)

•

Оценивание параметров

Интервальные оценки

IA [ 1 , 1 ] ... [ p , p ] :

i min i , i max i ,

A

i 1,..., p.

A

Точечные оценки

1 ,..., p :

2

2

^ 2

2

i 12 i i , i 1,..., p.

1

^ 1

1

1

Регрессия при интервальной ошибке

16

Регрессия при интервальной ошибке

Задачи, решаемые в отношении

множества неопределенности A (ОДЗ)

•

Предсказание значения отклика для

заданного значения аргумента

Интервальная оценка y

y( x) y( x), y( x):

y ( x) min T x,

A

y

y(x)

^y(x)

y(x)

y ( x) max T x,

A

Точечная оценка y

y ( x) 1 y ( x) y ( x)

2

x

x

Регрессия при интервальной ошибке

17

Регрессия при интервальной ошибке

Определение ценности наблюдений

2

A1

A3

D

C

B

A(2) A1 A2 ABDF

A2

A(3) A(2) A3 ABCEF

E

C( A3 )

F

A

A(2)

A(2) \ A(3)

,

где C(A3) – ценность порции

информации A3

1

Регрессия при интервальной ошибке

18

Область допустимых значений

40

a2

35

30

25

RPV

20

15

10

5

5

a 11

0

0

0

0

5

5

10

10

15

15

20

20

25

25

30

30

35

35

40

40

Регрессия при интервальной ошибке

19

ОДЗ в деталях. Обучающая выборка

ОДЗ в пространстве параметров

a2

1

18+

3

24

23

4

9

–

12

RPV

9–

20

13

SIC-Residual

28

График статусов объектов

2

+

2

0

3

10

1

18

24

14

7+

6

5

12

14

6

22

4 20

11

–

12

19

8 15

21

5 1617

0

1

16

14

16

18

20

Образцы

24

7 13

a1

SIC-Leverage

-1

22

Граничные образцы

C7

C9

C13

C14

C18

C23

—— —— —— —— —— ——

23

1

Регрессия при интервальной ошибке

20

Регрессия при интервальной ошибке

Планирование эксперимента

b22

B

A1 1

1.4

D

D

B2

A2

1.3

x

y 1 ln 1 , 0 x 2

2

1 1, 2 1, 0.1

1.2

BB33

1.1

HH

EE

1

A(2) A1 A2 ABCD

G

FF

A

C

А1 – МН наблюдения в точке x = 0.5

А2 – МН наблюдения в точке x = 0.8

A3 – МН наблюдения в точке x = 0.95

0.9

BB

0.8

1

1.2

1.4

1.6

1.8

1

A(3) A(2) A3 EFGH

Регрессия при интервальной ошибке

21

Регрессия при интервальной ошибке

1.

Принятие системно-технических решений по построению зависимости

2.

Сбор априорных знаний и данных

3.

Планирование эксперимента и включение новых порций информации

4.

Выявление и устранение противоречий

5.

Сжатие информации

6.

Расчет, анализ и уточнение параметров зависимости

Зависимость работоспособна?

Нет

Корректировка вида зависимости

Схема процесса построения и анализа зависимостей

Да

Да

Есть новая информация?

8.

Использование зависимости

7.

Нет

Регрессия при интервальной ошибке

Теоретико-множественное оценивание

История, имена и терминология

1962

1970

1982

1983

1989

1993

1994

1999

2003

Л.В. Канторович

С.И. Спивак

G. Belforte, M. Milanese

Н.М. Оскорбин (МЦН)

А.П. Вощинин

P.L. Combettes

С.И. Кумков

О.Е.Родионова, А.Л.Померанцев (ПИО)

А.А. Подружко, А.С. Подружко

22

Эксперименты по ММП- и

МЦН-прогнозированию

Схема эксперимента

Распределения ошибки

Результаты сравнения

24

Регрессия при интервальной ошибке

1.

2.

3.

Сравнение МЦН и ММП. Схема вычислительного

эксперимента

Модельная

зависимость

y 1 2 x

Таблица

наблюдений

T

y ММП

y МЦН

Ошибка с

плотностью

вероятностей

p(x)

Таблица

наблюдений

T

ММП-оценивание

y ММП

МЦН-оценивание

y МЦН

y*

d ММП

*

d МЦН

y

?

25

Регрессия при интервальной ошибке

Плотности распределения ошибки, использованные при

сравнении ММП и МЦН

p1

0

1 3

2 3

1

0

1 6

1 3

1 2

0

1 3

2 3

1

p2

p3

26

Среднеквадратичные отклонения оценок прогнозных

значений ММП и МЦН

Плотность вероятностей ошибки:

p2k ( x), k

k 1

20 2

Выявление выбросов

Идея метода

Простой пример

Примеры приложений

29

Регрессия при интервальной ошибке

Все указанные задачи имеют смысл

только в случае непустоты множества

неопределенности

Возможные причины пустоты множества

неопределенности:

Присутствие

выбросов в данных

Нарушение гипотезы о структуре модели

30

Выявление выбросов в данных

с интервальной ошибкой

Ключевая идея

Выброс

может рассматриваться как

измерение с недооцененной ошибкой

наблюдения (т.е. реальная ошибка

превосходит декларированную ошибку j)

Какова нижняя граница j' реальной ошибки,

обеспечивающая непустое множество

неопределенности?

31

Выявление выбросов в данных

с интервальной ошибкой

Насколько нужно «растянуть» интервал ошибки

чтобы мн-во неопределенности стало непустым?

В пространстве переменных

В пространстве параметров

2

y

Пусть j' = wj ·j

j

j '

wj = ?

x

1

32

Выявление выбросов в данных

с интервальной ошибкой

Множители wj могут быть найдены путем

решения следующей задачи оптимизации

n

min w j

,w

Множество

неопределенности с

подвижными

границами

…или “заморозить”

некоторые из

Можно

только

Некоторые

из

интервалов

увеличивать

измерений могут

интервалы

иметь

одинаковую

ошибок…

точность

j 1

(1)

y j w j j f ( x j , ) y j w j j , j 1,...,n (2)

w j 1, j 1,...,kn

(3)

w j 1, j k 1,...,n

(4)

w1 w2 ... w j1 ,

..........................,

w jm 1 w jm 2 ... wn

(5)

33

Выявление выбросов в данных

с интервальной ошибкой

Связь с робастным оцениванием

n

min w j

,w

Множество

неопределенности с

подвижными

границами

Можно только

расширять

интервалы…

j 1

(1)

y j w j j f ( x j , ) y j w j j , j 1,...,n (2)

w j 10,, j 1,...,n

Решение (*, w*) задачи (1)-(3') дает

Разрешаем масштабировать

* - M-оценку

параметров

(более точно - L1)

интервал

произвольно

(расширять и сжимать)

Весовая функция: W(x) = 1/|x|.

Остатки: ri = wj*·j.

(3')

(3)

34

Выявление выбросов в данных

с интервальной ошибкой

Пример

Выброс, обусловленный

Данные с выбросами,

столь очевидно.

1-я попытка

грубойНе

ошибкой.

порождающие пустое

РешениеПробуем

ЗЛПНеобходимо

(1)-(3)

удалитьпроверить

множество

точность метода C

это наблюдение

неопределенности

y = 1 + 2x

y

#

Measurement

method

x

y

w

1

A

1

2.13

0.20

1.000

2

A

2

2.95

0.20

1.000

9

3

A

3

5.01

0.20

4.686

8

4

A

4

4.99

0.20

1.000

7

5

A

5

5.97

0.20

1.000

6

6

B

6

7.04

0.40

1.000

5

7

B

7

8.02

0.40

1.000

4

8

C

8

8.15

0.40

1.343

9

C

9

10.01

0.40

1.000

10

D

10

10.98

0.50

1.000

11

10

3

2

1

x

1

2

3

4

5

6

7

8

9

10

35

Выявление выбросов в данных

с интервальной ошибкой

Пример

2-я попытка

Решение (1) с

ограничениями (2)-(3) и

w 8 = w9

y = 1 + 2x

#

Итоги

Не переоценена ли

точность метода C

на ~14%?

y

Measurement

x

method Для

1

A

2

A

3

A

4

A

5

A

6

B

7

11 необходимо найти

w

y

противоречий

устранения

ответы на следующие вопросы:

10

1

2.13

0.20

3

5.01

0.20

B

7

8.02

0.40

1.000

8

C

8

8.15

0.40

1.143

9

C

9

10.01

0.40

1.143

10

D

10

10.98

0.50

1.000

1.000

1. Действительно

ли

выброс9 #3 является

2

2.95

0.20

1.000

результатом грубой ошибки?

8

2. Является

грубой

7

4

4.99 ли

0.20выброс

1.000 #8 результатом

ошибки

? 0.20 1.000

5

5.97

6

ИЛИ

6

7.04

0.40

1.000

5

Не переоценена ли точность

метода C?

4

3

2

1

x

1

2

3

4

5

6

7

8

9

10

36

Геометрическая коррекция спутниковых

изображений

Результирующая

система координат

u

Исходное изображение

x

Геометрическое преобразование

+

y

+ ++ +

x a00 a10u a01v a11uv a20u 2 a02 v 2 ,

y b00 b10u b01v b11uv b20u 2 b02 v 2 .

v

+

+

+

+

Указываются оператором

Получены высокоточными

методами (GPS, крупно+ с ошибкой не менее

+

+

одного пиксела

масштабные

карты)

После устранения выбросов

и

построения преобразования

Таблица результирующее

опорных точек

строится

Координаты

на

изображение

Эталонные координаты

изображении

#

Выбросы выявляются «на

x

y

u

v

лету» и оператор

1

2935

3072

14486,30

5991,49

получает уведомление

2

2045

2745

14349,30

5927,55

14

1795

2714

14309,60

5919,30

+

37

Геометрическая коррекция спутниковых

изображений

Позиционная неопределенность (x x)+(y y),

пикселов

изображение

опорными точками

ИтоговоеИтоговое

изображение

с картой спозиционной

неопределенности

38

Поиск интервалов неопределенности

Исходные данные:

BC,CD, DA с ошибкой p;

координаты тт. R, S с ошибкой g;

AR, BS с ошибкой r ;

ошибка угловых измерений a;

AB,

Найти:

Интервалы неопределенности

для координат тт. A, B, C, D

x

S

B

A

C

D

R

y

Планирование эксперимента

Контекст

Критерии оптимальности плана эксперимента

Сравнение D- и IE-оптимального планирования

Результаты сравнения

Планирование эксперимента

40

Планирование эксперимента: контекст

Оптимизация продуктов или процессов

Оптимизация качества модели

планирование

Планирование

N наблюдений

Начало

Последовательное

Эксперимент

Эксперимент

Анализ

Конец

Начало

Статическое

планирование

Анализ

Качество модели

удовлетворительно?

Конец

Планирование

~1 наблюдения

Планирование эксперимента

41

Планирование эксперимента

в регрессии с интервальной ошибкой

Обозначения

y xT , x

R

p

x1T

X

xnT

M XTX

-

пространство

эксперимента

1

-

матрица плана

D M 1

1

y1

Y - наблюдения

yn

отклика

1

E

n

- модель

-

границы

ошибок

0

d ( x) xT Dx

информационная

матрица

- ковариационная

матрица

-

-

стандартизованная функция

вариации y(x,)

Планирование эксперимента

42

Планирование эксперимента

в регрессии с интервальной ошибкой

Критерии оптимальности плана эксперимента

Зависят только от X,

т.е. применимы и к

случаю

Dинтервальному

= (XTX)–1

Классические

Наименование

Минимизирует

D-оптимальность det D (объем доверительного эллипсоида)

G-оптимальность max d ( x) (максимальную вариацию прогноза)

x

Критерии

IE- и IGTDx

d(x)

=

x

Интервальные (M.П. Дывак)

оптимальности

Наименование

Минимизируетэквивалентны для

сферического

ID -оптимальность квадрат объема Aпространства

эксперимента

иn>p A

IE -оптимальность квадрат максимальной

диагонали

IG -оптимальность максимальную ошибку предсказания

Планирование эксперимента

Планирование эксперимента

в регрессии с интервальной ошибкой

Мотивация

Классические

методы планирования эксперимента

используют только информацию из X, не используя

YиE

Интервальные

методы планирования эксперимента

Н.П.Дывака работают для насыщенных планов (p=n)

и используют X, E, но не Y.

Позволяет

ли задействование информации из Y

повысить качество конструируемой модели, или

увеличить «скорость» процедуры

последовательного планирования эксперимента?

43

Планирование эксперимента

44

Планирование эксперимента

в регрессии с интервальной ошибкой

Как использовать информацию, заключенную в Y?

xnext = IEDesign( , X, Y, E)

1.

Найти направление a

максимальной протяженности A:

Множество неопределенности

A(X,Y,E)

2

{1* , 2*} arg max 1 2 ,

a

*

1

2.

*

2

1 , 2 A

След. экспериментальная точка

xnext выбирается так, что

Порождает ограничение,

ортогональное a

• Имеет максимальную норму

(наим. ширину ограничения

•

w 2 xnext )

xnext k *a, k * max | k |

kR , ka

w

1

Планирование эксперимента

Планирование эксперимента

в регрессии с интервальной ошибкой

IE-оптимальнoе последовательное планирование

(X0, Y0, E0) – начальный набор данных

i = 0;

repeat

x = IEDesign( , Xi, Yi, Ei);

45

Планирование эксперимента

Планирование эксперимента

в регрессии с интервальной ошибкой

IE-оптимальнoе последовательное планирование

(X0, Y0, E0) – начальный набор данных

i = 0;

repeat

x = IEDesign( , Xi, Yi, Ei);

y = наблюдение в x с ошибкой ;

X

Y

E

X i 1 Ti ; Yi 1 i ; Ei 1 i ;

y

x

i = i + 1;

until i > N or IA(Xi, Yi, Ei) мала;

46

Планирование эксперимента

47

Планирование эксперимента

в регрессии с интервальной ошибкой

Исследование 1. Сравнение IE- и D-оптимального

последовательного планирования при нулевой ошибке

x R

2

0.26 0.61

x x 1 , (1, 2) , 0.4, X 0 0.59 0.24

0.49 0.31

T

IE-оптимальное планирование

i 0

repeat

Yi X i

xnext I E Design , X i , Yi ,

Xi

X i 1

x

next

i i 1

until i > 9

T

D-оптимальное планирование

i 0

repeat

xnext DDesign , X i

X

X i 1 i

xnext

i i 1

until i > 9

Планирование эксперимента

48

Планирование эксперимента.

в регрессии с интервальной ошибкой

Исследование 1. Результаты D-оптимального планирования

В области переменных

1,5,9

1

В области параметров

3

3,7

2

2.5

0.5

2

0

-0.5

1.5

2,6,10

-1

4,8

-1

-0.5

0

0.5

1

1

0

0.5

1

1.5

Volume(A) = 0.6400 42

IA = [0.45, 1.55][1.45, 2.55]

Volume(IA) = 1.21

2

Планирование эксперимента

49

Планирование эксперимента

в регрессии с интервальной ошибкой

Исследование 1. Результаты IE-оптимального планирования

В области переменных

В области параметров

3

1

2

2.5

0.5

0

2

-0.5

1.5

-1

-1

-0.5

0

0.5

1

1

0

0.5

1

1.5

Volume(A) = 0.5077 2

IA = [0.59, 1.41][1.60, 2.40]

Volume(IA) = 0.66

2

Планирование эксперимента

50

Планирование эксперимента

в регрессии с интервальной ошибкой

Исследование 2. Сравнение IE- и D-оптимального

последовательного планирования при ошибке с усеченным

нормальным распределением

x R d xT x 1 , (1, 2)T , 0.4,

X 0 { 3 равномерно распределенных точки из

Ошибки имитируются

}

NT ( ) – усеч. норм. распределение

N T ( )

3s

Планирование эксперимента

51

Планирование эксперимента

в регрессии с интервальной ошибкой

Исследование 2

k 0;

for r = 1 to 1500 do

i 0; Ξ 0 { 3 случайных значения из N T ( ) };

X 0 { 3 равномерно распределенных точки из }; Y0 X 0 Ξ 0 ;

X 0D X 0 ; Y0D Y0 ;

X 0I X 0 ; Y0I Y0 ;

repeat

случайное значениеиз N T ( );

x I I E Design , X iI , Yi I , ;

y I x I

X iI

Yi I

I

I

X i 1 I ; Yi 1 I ;

x

y

i i 1;

x D DDesign , X iD ;

y D x D

X iD

Yi D

D

D

X i 1 D ; Yi 1 D ;

x

y

until i > N

if Volume IAX NI , YNI , Volume IAX ND , YND , then k k 1;

end for

Планирование эксперимента

52

Планирование эксперимента

в регрессии с интервальной ошибкой

Количество «побед»

k, (1500 – k)

2

T

Исследование 2. Результаты для x R x x 1 ,

1500

100%

90%

1250

80%

70%

1000

60%

50%

750

40%

500

30%

20%

250

IE-Design

10%

D-Design

0

0

5

10

15

Количество спланированных точек

20

N

25

0%

Планирование эксперимента

53

Планирование эксперимента

в регрессии с интервальной ошибкой

Количество «побед» k,

(1500 – k)

Исследование 2. Результаты для

x R 3 xT x 1 ,

1500

100%

90%

1250

80%

70%

1000

60%

50%

750

40%

500

30%

20%

250

IE-Design

10%

D-Design

0

0

5

10

15

20

Количество спланированных точек N

25

0%

54

Планирование эксперимента

в регрессии с интервальной ошибкой

Исследование 2. Результаты для x R p x T x 1 ,

Распределение ошибки – равномерное

55

Планирование эксперимента

в регрессии с интервальной ошибкой

Исследование 2. Результаты для x R p x T x 1 ,

Распределение ошибки – усеченное нормальное

Планирование эксперимента

56

Планирование эксперимента

в регрессии с интервальной ошибкой

«Цена» of IE-оптимального планирования

Задача поиска направления наибольшей протяженности

множества A

{1* , 2*} arg max 1 2

1 , 2 A

-- задача невыпуклого квадратичного программирования

(ЗНКП)

Доказано, что ЗНКП NP-трудна, т.е. время решения задачи

экспоненциально зависит от ее размерности (количества

предикторов p)

Решение проблемы – в использовании субоптимальных

решений или в использовании специальных вычислительных

средств (параллельные системы и т.п.)

Вопросы и ответы

Вопросы?

Регрессия при интервальной ошибке

Регрессия: классический взгляд

Ошибки: нормальные или ограниченные

Регрессия при интервальной ошибке: основы

Регрессия при интервальной ошибке:

открытые вопросы

Эксперименты по ММП- и

Выявление выбросов

МЦН-прогнозированию

Схема эксперимента

Распределения ошибки

Результаты сравнения

Идея метода

Простой пример

Примеры приложений

Планирование эксперимента

Контекст

Критерии оптимальности плана эксперимента

Сравнение D- и IE-оптимального планирования

Результаты сравнения

57

58

Библиография

1.

2.

3.

4.

5.

6.

Канторович Л.В. О некоторых новых подходах к вычислительным

методам и обработке наблюдений // Сиб. мат. журнал. – 1962. –

Т.3. – № 5. – С. 701-709.

Алимов Ю.И., Кравцов Ю.А. Является ли вероятность

«нормальной» физической величиной? // УФН. – 1992. – Т.162. –

№7. – С. 149-182.

Белов В.М., Суханов В.А., Унгер Ф.Г. Теоретические и

прикладные аспекты метода центра неопределенности. –

Новосибирск: Наука. Сибирская издательская фирма РАН, 1995.

– 144 c.

Вощинин А.П., Сотиров Г.Р. Оптимизация в условиях

неопределенности. – М., София: Изд-во МЭИ, Техника, 1989. –

224 с.

Вощинин А.П. Интервальный анализ данных: развитие и

перспективы. // Заводская лаборатория. Диагностика материалов.

– 2002. – Т.68. – №.1. – С. 118-126.

Жилин С.И. Эксперименты по оцениванию параметров

эмпирической зависимости методом наименьших квадратов и

методом центра неопределенности. // Известия Алтайского

государственного университета. – 2003. – №1. – С. 24-27.

59

Библиография

7.

8.

9.

10.

11.

12.

Куржанский А.Б. Управление и наблюдение в условиях

неопределенности. – М.: Наука, 1977. – 390 c.

Новицкий П.В., Зограф И.А. Оценка погрешностей результатов

измерений. – Л.: Энергоатомиздат, 1985. – 248 с.

Оскорбин Н.М. Некоторые задачи обработки информации в

управляемых

системах

//

Cинтез

и

проектирование

многоуровневых

иерархических

систем.

Материалы

конференции.

–

Барнаул:

Алтайский

государственный

университет, 1983.

Оскорбин Н.М., Жилин С.И., Дронов С.В. Сравнение

статистической и нестатистической оценок параметров

эмпирической

зависимости.

//

Известия

Алтайского

государственного университета. – 1998. – №4. – C. 38-41.

Спивак С.И. Детальный анализ применения методов линейного

программирования при определении параметров кинетической

модели // Математические проблемы химии. – Новосибирск: ВЦ

СО АН СССР, 1975. – Ч. 2. – С. 35-42.

Хлебников А.И. О проблемах использования метода центра

неопределенности для обработки экспериментальных данных //

Вычислительные технологии. – 1999. – T.4. – №4. – С. 80-81.

60

Библиография

13.

14.

15.

16.

17.

18.

19.

Эльясберг П.Е., Измерительная информация. Сколько ее нужно,

как ее обрабатывать? – М.: Наука, 1983. – 208 с.

Bounding Approaches to System Identification / Milanese M., Norton

J., Walter E., editors. – London: Plenum Press, 1996. – 586 p.

Combettes P.L. Foundations of set-theoretic estimation // Proc. of

IEEE. – 1993. – Vol. 81. – №2. – P. 182-208.

Milanese M., Belforte G. Estimation Theory and Uncertainty Intervals

Evaluation in Presence of Unknown But Bounded Errors: Linear

Families of Models and Estimators // IEEE Transactions on

Automatic Control. – 1982. –Vol. 27. – № 2. – P. 408-414.

Rodionova O.Ye., Esbensen K.H., Pomerantsev A.L., "Application of

SIC (Simple Interval Calculation) for object status classification and

outlier detection - comparison with PLS/PCR", J. Chemometrics, 18 ,

402-413 ( 2004)

Zhilin S.I. On Fitting Empirical Data under Interval Error // Reliable

Computing. - 2005. - Vol. 11. - №5. - P. 433-442.

Zhilin S.I. Simple Method for Outlier Detection in Fitting Experimental

Data Under Interval Error // Chemometrics and Intellectual

Laboratory Systems - 2007. Vol. 88. - №1. - P. 60-68.

61

Библиография

20.

21.

22.

23.

24.

25.

Суханов В.А. Исследование эмпирических зависимостей:

нестатистический подход. – Барнаул: Изд-во Алт. ун-та, 2007. –

290 с.

Rodionova O.Ye., Pomerantsev A.L. Simple view on Simple Interval

Calculation (SIC) method // Chemom. Intell. Lab.Syst., 97 (1), 64-76

(2009)

Дивак М.П. Задачі математичного моделювання cтатичних

систем з інтервальними даними. – Тернопіль: Економічна думка

ТНЕУ, 2011. – 216 c.

Жилин С.И. Решение задач дисперсионного и ковариационного

анализа методом центра неопределенности // Известия

Алтайского государственного университета. – 2011. – №1/2. – C.

54-57.

Шарый С.П. Разрешимость интервальных линейных уравнений и

анализ данных с неопределённостями // Автоматика и

Телемеханика. – 2012. – №2 – С. 111–125.

Шарый С.П., Шарая И.А. Распознавание разрешимости

интервальных уравнений и его приложения к анализу данных //

Вычислительные Технологии. – 2013. – Т. 18, №3. – С. 80–109.