Ветров Д., Кропотов Д.

реклама

72

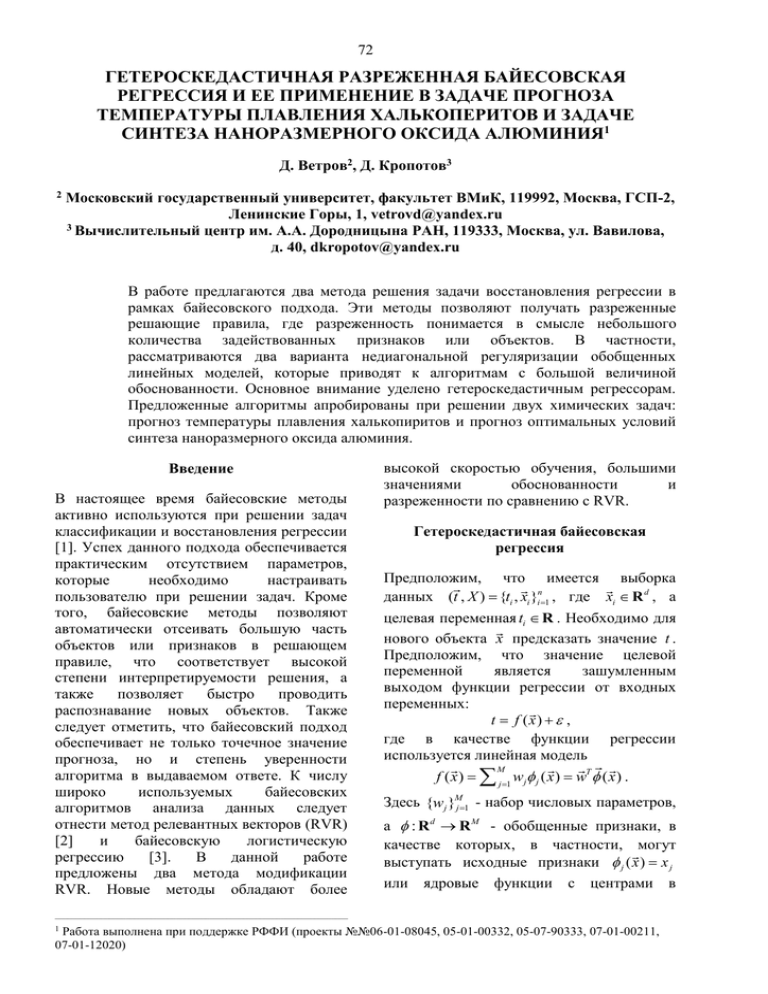

ГЕТЕРОСКЕДАСТИЧНАЯ РАЗРЕЖЕННАЯ БАЙЕСОВСКАЯ

РЕГРЕССИЯ И ЕЕ ПРИМЕНЕНИЕ В ЗАДАЧЕ ПРОГНОЗА

ТЕМПЕРАТУРЫ ПЛАВЛЕНИЯ ХАЛЬКОПЕРИТОВ И ЗАДАЧЕ

СИНТЕЗА НАНОРАЗМЕРНОГО ОКСИДА АЛЮМИНИЯ1

Д. Ветров2, Д. Кропотов3

2

Московский государственный университет, факультет ВМиК, 119992, Москва, ГСП-2,

Ленинские Горы, 1, vetrovd@yandex.ru

3 Вычислительный центр им. А.А. Дородницына РАН, 119333, Москва, ул. Вавилова,

д. 40, dkropotov@yandex.ru

В работе предлагаются два метода решения задачи восстановления регрессии в

рамках байесовского подхода. Эти методы позволяют получать разреженные

решающие правила, где разреженность понимается в смысле небольшого

количества задействованных признаков или объектов. В частности,

рассматриваются два варианта недиагональной регуляризации обобщенных

линейных моделей, которые приводят к алгоритмам с большой величиной

обоснованности. Основное внимание уделено гетероскедастичным регрессорам.

Предложенные алгоритмы апробированы при решении двух химических задач:

прогноз температуры плавления халькопиритов и прогноз оптимальных условий

синтеза наноразмерного оксида алюминия.

Введение

В настоящее время байесовские методы

активно используются при решении задач

классификации и восстановления регрессии

[1]. Успех данного подхода обеспечивается

практическим отсутствием параметров,

которые

необходимо

настраивать

пользователю при решении задач. Кроме

того, байесовские методы позволяют

автоматически отсеивать большую часть

объектов или признаков в решающем

правиле, что соответствует высокой

степени интерпретируемости решения, а

также

позволяет

быстро

проводить

распознавание новых объектов. Также

следует отметить, что байесовский подход

обеспечивает не только точечное значение

прогноза, но и степень уверенности

алгоритма в выдаваемом ответе. К числу

широко

используемых

байесовских

алгоритмов анализа данных следует

отнести метод релевантных векторов (RVR)

[2]

и

байесовскую

логистическую

регрессию

[3].

В

данной

работе

предложены два метода модификации

RVR. Новые методы обладают более

высокой скоростью обучения, большими

значениями

обоснованности

и

разреженности по сравнению с RVR.

Гетероскедастичная байесовская

регрессия

Предположим, что имеется выборка

данных (t , X ) {ti , xi }in1 , где xi R d , а

целевая переменная ti R . Необходимо для

нового объекта x предсказать значение t .

Предположим, что значение целевой

переменной

является

зашумленным

выходом функции регрессии от входных

переменных:

t f (x) ,

где в качестве функции регрессии

используется линейная модель

M

f ( x ) j 1 w j j ( x ) wT ( x ) .

Здесь {w j }Mj 1 - набор числовых параметров,

а : R d R M - обобщенные признаки, в

качестве которых, в частности, могут

выступать исходные признаки j ( x ) x j

или ядровые функции с центрами в

______________________________________________________________________

Работа выполнена при поддержке РФФИ (проекты №№06-01-08045, 05-01-00332, 05-07-90333, 07-01-00211,

07-01-12020)

1

73

объектах обучения j ( x ) K ( x j , x ) . Пусть

шумовая компонента имеет независимое

нормальное распределение с нулевым

математическим ожиданием и дисперсией

пропорциональной

значению

целевой

переменной:

i N (0, ti 2 )

Тогда правдоподобие обучающей выборки

может быть представлено как

p ( | w) p (t | X , w)

n

(ti f ( xi , w)) 2

2ti 2

exp

i 1

(1)

(t w)T B (t w)

exp

,

2 2

1

1

где B diag(t ,

1

n

,t ) , а

M ( x1 )

1 ( x1 )

[ ( x1 ), , ( xn )]

.

(x )

M ( xn )

1 n

Заметим, что случай гомоскедастичной

регрессии

соответствует

единичной

матрице B .

Байесовский подход предполагает задание

априорных распределений на параметры

алгоритма w . Выберем в качестве

априорного распределения нормальное

распределение с центром в нуле и матрицей

ковариации A1 :

p( w | A) N (0, A1 )

Прогноз значения целевой переменной для

нового объекта x* вычисляется как

интеграл по всевозможным значениям

параметров алгоритма w :

(2)

p(t | x ) p (t | x , w) p ( w | X , T , A)dw

T

*

*

*

*

Здесь p( w | X , T , A)

p(T | w, X ) p(w | A)

p(T | w, X ) p(w | A)dw

N ( , ),

( 2T B A)1 2T Bt

Выражение (2) представляет собой свертку

двух нормальных распределений и может

быть вычислено как

p (t* | x* ) N ( * , *2 )

* T ( x* ) *2 2 ( x* )T ( x* )

Оптимальное

значение

матрицы

регуляризации A из некоторого семейства

A

матриц

находится с помощью

максимизации величины обоснованности:

Aopt arg max p (t | X , w) p ( w | A)dw

AA

arg max N (t | 0, 2 B 1 A1T )

(3)

AA

В дальнейшем рассматриваются два

A,

семейства

матриц

обладающих

различными интересными свойствами.

Регуляризация вдоль собственных

векторов гессиана логарифма

правдоподобия

Рассмотрим функцию правдоподобия (1).

Она может быть представлена как

p (t | X , w)

1

p (t | X , wML ) exp ( w wML )T H ( w wML )

2

T

1 T

2 T

wML ( B ) Bt H B

Здесь H играет роль гессиана логарифма

правдоподобия. Рассмотрим собственные

значения и собственные векторы матрицы

H : H QT Q, diag(1 , , M ), u Qw .

Выберем в качестве семейства матриц A

набор

матриц,

соответствующих

независимой

регуляризации

вдоль

собственных векторов u :

p (u | A* ) N (0, A* ), A* diag (a1 , , aM )

p ( w | A) N (0, A), A QT A*Q

Основным

достоинством

такой

регуляризации является то, что значение

обоснованности в терминах u может быть

представлено

как

произведение

одномерных интегралов, каждый из

которых может быть легко вычислен

аналитически. Оптимальные значения a

равны

j

, если j uML , j 1

a j j uML , j 1

uML QwML

, иначе

Для оценки значения 2 может быть

использована итерационная процедура,

предложенная в [2]:

(t )T B(t )

( 2 )new

j 1 a j jj

M

n j 1 j

74

Регуляризация в семействе

симметричных неотрицательно

определенных матриц

Выберем следующее семейство матриц

регуляризации:

A { A R M M | AT A, A 0}

Приравнивая производную обоснованности

(3) по матрице A к нулю, получаем

следующее выражение для оптимальной

матрицы регуляризации [4]:

1

T

Aopt

wML wML

H 1

1

Матрица Aopt

симметричная, но, вообще

говоря, не является неотрицательно

определенной. Преобразуем матрицу к

1

диагональному виду D U T Aopt

U . Так как

матрица

T

wML wML

0

имеет ранг 1, а

1

H 0 , то в диагональной матрице D

только одна компонента может быть

положительной. Обозначим ее через d1 .

Тогда можно показать, что оптимальная

неотрицательно определенная матрица

регуляризации может быть получена из

1

заменой

всех

отрицательных

Aopt

собственных значений на

D 1 diag(d11 , ,..., ) .

,

т.е.

Задача прогноза температуры плавления

халькопиритов

В

последнее

время

внимание

исследователей привлекли полупроводники

с

тетрагональной

кристаллической

структурой халькопирита. Интерес к

халькопиритам вызван перспективами их

применения в оптоэлектронике [5,6],

солнечной энергетике [6], нелинейной

оптике [7] и спинтронике [8]. Задача

состоит в прогнозе температуры плавления

халькопирита по данным о составляющих

его химических элементах. Обучающая

выборка состоит из 40 халькопиритов (см.

таблицу 1), а тестовая выборка – из 14

элементов (см. таблицу 3).

Для решения данной задачи использовалась

гетероскедастичная

регрессия,

т.к.

традиционно в химии точность прогноза

температуры измеряется в доле отклонения

от абсолютной величины. В экспериментах

участвовали

три

метода:

метод

релевантных

векторов

(RVR),

предложенный метод с регуляризацией

вдоль собственных векторов гессиана

логарифма правдоподобия (REVR) и

предложенный метод с регуляризацией в

семействе симметричных неотрицательных

матриц (IREVR). Каждый раз в качестве

обобщенных признаков использовались

следующие:

2

j ( x ) exp x j x / 2 s 2 , j 1, n, n 1 ( x ) 1,

а параметр s 2 настраивался с помощью

скользящего контроля.

Таблица 1. Вещества, входящие в

обучающую выборку

AgTlTe2

AgFeSe2 CuFeS2

CuTlTe2

CuFeTe2 CuInSe2

ZnSnSb2

CdSnP2

AgGaS2

LiGaTe2

ZnSnAs2 ZnGeP2

CuTlSe2

AgInSe2

CuAlSe2

CuFeSe2

CuInTe2

CuGaSe2

CdSnAs2

CdGeP2

CuInS2

AgTlSe2

AgGaSe2 ZnSiAs2

LiInTe2

CdSiAs2 CdSiP2

CdGeAs2

CuGaTe2 CuGaS2

AgFeTe2

ZnGeAs2 ZnSiP2

AgInTe2

AgInS2

CuAlS2

AgGaTe2

CuAlTe2

AgAlTe2

ZnSnP2

В таблице 2 приведены результаты

экспериментов на обучающей выборке. Для

оценки качества использовался следующий

критерий:

1

WRMSE

(t )T B(t )

n

Значение критерия оценивалось с помощью

скользящего контроля (5x2-fold cross

validation).

Результаты

экспериментов

приведены для трех наборов признаков.

Набор признаков П1 состоит из простых

химических

признаков

каждого

из

элементов,

входящего

в

состав

халькопирита. Набор П2 представляет

собой специально отобранные признаки,

полученные в результате исследования.

Набор П3 – это набор П2 с добавлением

логарифмов всех признаков. Результаты

прогноза для набора П1 лишь немногим

лучше

погрешности

в

20%,

что

соответствует точности, с которой эксперт

75

решает эту задачу вручную. Наборы П2 и

П3 позволяют добиться точности в 14%,

что уже значительно лучше, чем точность

экспертной оценки.

Таблица 2. Результаты экспериментов

Метод П1

П2

П3

RVR

0.195 ± 0.173 ± 0.155 ±

0.009

0.027

0.026

REVR

0.182 ± 0.155 ± 0.142 ±

0.009

0.004

0.024

IREVR 0.177 ± 0.151 ± 0.143 ±

0.007

0.004

0.016

В таблице 3 приведен прогноз для тестовой

выборки, полученный с помощью метода

IREVR.

Таблица 3. Прогноз температуры

плавления

Вещество Прогноз

Ст.отклонение

ZnAlS2

1432,1537

118,6126

ZnAlSe2

1265,6839

113,9763

ZnAlTe2

1077,854

112,9513

ZnGaTe2 1006,2543

113,4827

CdGaTe2 901,5154

114,5348

HgGaTe2 688,0056

117,1578

AgFeS2

1177,1537

113,7476

AgAlS2

1430,2483

116,9982

AgAlSe2

1225,4362

113,2886

ZnGeN2

1420,5192

116,9595

MgSiP2

1391,4328

118,5705

MnGeP2

1258,7763

115,1215

MgGeAs2 1201,7747

113,6561

BeCN2

929,7983

116,0099

Задача синтеза наноразмерного оксида

алюминия

Задача синтеза дешевых наноразмерных

материалов из окиси алюминия является

одной из актуальных проблем современной

химии [10]. В качестве предшествующего

материала

часто

используется

гидрокарбонат алюмаммония (AACH), для

синтеза которого проводится реакция с

участием NH4Al(SO4)2 и NH4HCO3. В

данном исследовании решалась задача

прогноза выхода AACH в процентах при

различных

условиях

этой

реакции.

Обучающая выборка состояла из 34

объектов, а тестовая – из двух. Результаты

экспериментов приведены в таблицах 4 и 5.

Эти

результаты

показывают,

что

предложенные методы работают в целом

лучше, чем метод релевантных векторов, а

качество прогноза оказалось лучше, чем у

используемого

химиками

алгоритма

решения данной задачи на основе метода

опорных векторов [9].

Таблица 4. Результаты экспериментов на

обучающей выборке

Метод

WRMSE

RVR

0.061 ± 0.030

REVR

0.046 ± 0.010

IREVR

0.036 ± 0.005

Таблица 5. Прогноз выхода AACH

Объект Правильный Прогноз Прогноз

ответ

[9]

IREVR

1

100%

96.51%

97.51%

2

100%

95.99%

96.93%

Список литературы

1. C.M. Bishop. Pattern recognition and machine

learning. Springer. - 2006.

2. M.E. Tipping. Sparse Bayesian learning and the

relevance vector machine // Journal of Mach. Learn.

Res. – 2001. – Vol.1. – P.211-244.

3. G.C. Cawley, N.Talbot, M.Girolami. Sparse

multinomial logistic regression via Bayesian l1

regularization // Advances in neural information

processing systems. – 2007. – Vol.19. - MIT press.

4. D.Kropotov, D.Vetrov. Optimal Bayesian linear

classifier with arbitrary Gaussian regularizer // Proc.

of 7th Open German-Russian Workshop “Pattern

Recognition and Image Understanding”, to appear

5. V.S. Vavilov. Physics and applications of wide

bandgap semiconductors // Physics - Uspekhi. 1994. - V.37, No.3 - P. 269-277.

6. S. Siebentritt. Wide gap chalcopyrites: material

properties and solar cells // The solid films. - 2002.

V.403-404. - P.1-8.

7. Bai L., Lin Z., Wang Z., Chen C. Mechanism of

linear and nonlinear optical effects of chalcopyrite

AgGaX2 (X = S, Se, and Te) crystals // J. Chem.

Phys. - 2004. - V.120, No.18. - P.8772-8778.

8. Pearton S.J., Abernathy C.R., Norton D.P., et al.

Advances in wide bandgap materials for

semiconductor spintronics // Mater. Sci. and Eng. 2003. - V.R40. - P.137-168.

9. Chi-Cheng Ma, Xue-Xi Zhou. Using Support vector

machine in the optimization design for the

preparation of ACCH

10. Chi-Cheng Ma, Xue-Xi Zhou, et al. Synthesis and

thermal decomposition of ammonium aluminate

carbonate hydroxide (AACH) // Materials Chemistry

and Physics. – 2001. – Vol.72. – P.374-379.