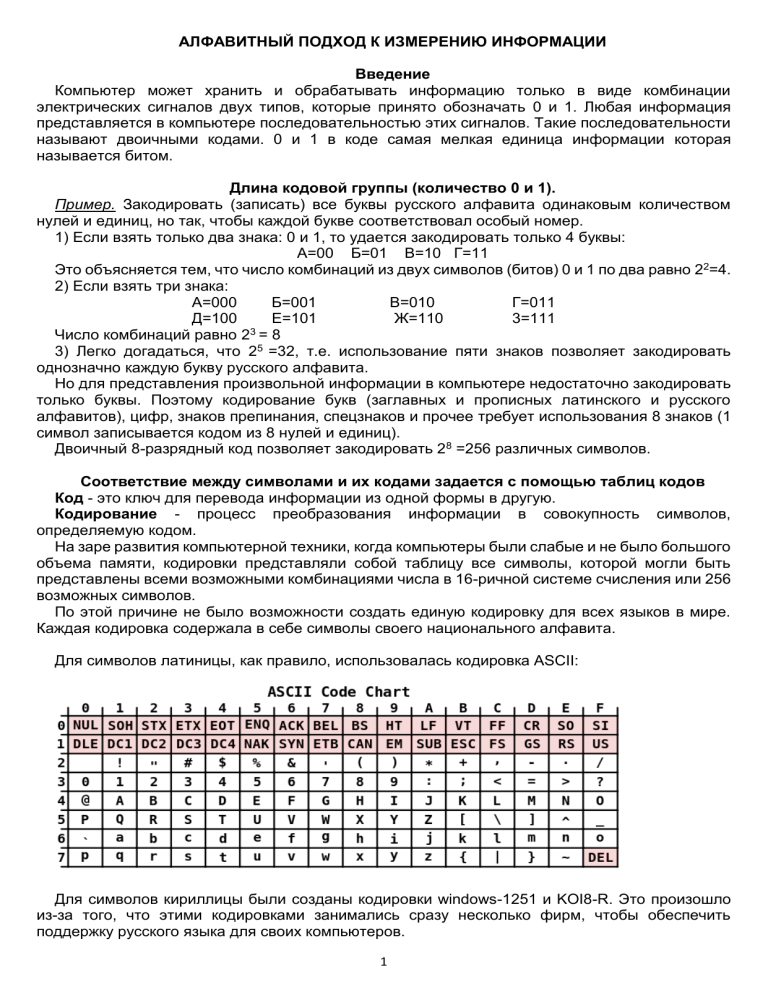

АЛФАВИТНЫЙ ПОДХОД К ИЗМЕРЕНИЮ ИНФОРМАЦИИ Введение Компьютер может хранить и обрабатывать информацию только в виде комбинации электрических сигналов двух типов, которые принято обозначать 0 и 1. Любая информация представляется в компьютере последовательностью этих сигналов. Такие последовательности называют двоичными кодами. 0 и 1 в коде самая мелкая единица информации которая называется битом. Длина кодовой группы (количество 0 и 1). Пример. Закодировать (записать) все буквы русского алфавита одинаковым количеством нулей и единиц, но так, чтобы каждой букве соответствовал особый номер. 1) Если взять только два знака: 0 и 1, то удается закодировать только 4 буквы: А=00 Б=01 В=10 Г=11 Это объясняется тем, что число комбинаций из двух символов (битов) 0 и 1 по два равно 22=4. 2) Если взять три знака: А=000 Б=001 В=010 Г=011 Д=100 Е=101 Ж=110 3=111 Число комбинаций равно 23 = 8 3) Легко догадаться, что 25 =32, т.е. использование пяти знаков позволяет закодировать однозначно каждую букву русского алфавита. Но для представления произвольной информации в компьютере недостаточно закодировать только буквы. Поэтому кодирование букв (заглавных и прописных латинского и русского алфавитов), цифр, знаков препинания, спецзнаков и прочее требует использования 8 знаков (1 символ записывается кодом из 8 нулей и единиц). Двоичный 8-разрядный код позволяет закодировать 28 =256 различных символов. Соответствие между символами и их кодами задается с помощью таблиц кодов Код - это ключ для перевода информации из одной формы в другую. Кодирование - процесс преобразования информации в совокупность символов, определяемую кодом. На заре развития компьютерной техники, когда компьютеры были слабые и не было большого объема памяти, кодировки представляли собой таблицу все символы, которой могли быть представлены всеми возможными комбинациями числа в 16-ричной системе счисления или 256 возможных символов. По этой причине не было возможности создать единую кодировку для всех языков в мире. Каждая кодировка содержала в себе символы своего национального алфавита. Для символов латиницы, как правило, использовалась кодировка ASCII: Для символов кириллицы были созданы кодировки windows-1251 и KOI8-R. Это произошло из-за того, что этими кодировками занимались сразу несколько фирм, чтобы обеспечить поддержку русского языка для своих компьютеров. 1 Таблица с кодировкой Windows-1251 Кодировка KOI8-R: С развитием вычислительной мощности компьютеров, стало возможным для кодирования различным символов использовать намного больше единиц информации и решено было создать универсальную кодировку для всех языков в мире. Такой кодировкой стала кодировка UTF (Юникод). Это огромная таблица, которая содержит более 1 миллиона закодированных символов. Вот небольшая часть этой таблицы: В настоящее время эта кодировка стала стандартом для всех компьютеров в мире. Юникод содержит не только символы мировых алфавитов, но и различные значки, смайлики и др. символы. 2 Алфавитный подход к измерению информации Выдающийся советский математик прошлого века Андрей Николаевич Колмогоров предложил подход к измерению информации, который получил название алфавитный. Алфавит – это множество отличных друг от друга символов, используемых в каком-либо языке. Мощность алфавита - это количество символов в нем. Примеры: алфавит кириллица латиница двоичная система счисления десятичная система счисления АБВГДЕЖЗИЙКЛМНОПРСТУФХЦЧШЩЪЫЬЭЮЯ ABCDEFGHIJKLMNOPQRSTUVWXYZ мощность алфавита (N) 32 26 10 2 0123456789 10 При алфавитном подходе один бит – это количество информации, которое можно передать сообщением из одного двоичного значка, то есть «0» или «1». Важные особенности алфавитного подхода: сообщения, записанные на естественном языке, кодируются без учета их смыслового содержания (такой подход является объективным); каждый символ несёт одинаковое количество информации, не учитывается, что некоторые символы могут встречаться в сообщении чаще других. Информационная емкость одного символа Количество информации i, которое несет один символ (информационная емкость одного символа алфавита) в тексте, и мощность алфавита N связаны формулой: 2i = N Пример 1. Определить по формуле количество информации, которое несет знак в двоичной знаковой системе Решение Ответ: информационная емкость знака двоичной знаковой системы составляет 1 бит. Пример 2. Определить, какое количество информации несет буква русского алфавита (без буквы ё). Решение Ответ: буква русского алфавита несет 5 битов информации. Количество информации в сообщении Сообщение состоит из последовательности знаков, каждый из которых несет определенное количество информации. Количество информации в сообщении можно посчитать, умножив количество информации, которое несет один знак на количество знаков в сообщении. где — количество информации в сообщении — количество информации, которое несет один знак — количество знаков в сообщении 3 Пример 1. Определить какое количество информации содержит слово «ПРИВЕТ», если считать, что алфавит состоит из 32 букв? Дано: К=6 N = 32 Найти: Ic -? (Какое количество информации содержит слово «ПРИВЕТ») Решение 1) 2) = 6 * 5 = 30 (бит) Ответ: слово «Привет» содержит 30 бит информации. Пример 2. Информационное сообщение объёмом 720 битов состоит из 180 символов. Какова мощность алфавита, с помощью которого записано это сообщение? Дано: Iс = 720 бит K = 180 символов Найти: N-? Решение 1) I = Ic / K = 720 / 180 = 4 (бита) 2) N = 24 = 16 Ответ: мощность алфавита 16. 4